第六章 匹配滤波-卷积神经网络(MF-CNN)模型的应用研究¶

6.1 引言¶

第一个双黑洞 (black holes, BHs) 并合系统产生的引力波 (gravitational waves, GWs) 探测事件 (GW150914) 由 aLIGO (advanced Laser Interferometer Gravitational-wave Observatory) 组织 7 所发现并确认,这为整个物理学和天文学界带来了巨大的变革 8,并于 2017 年获得了诺贝尔物理学奖。此后,硕果累累的重大引力波发现 9 10 11 为实验物理、理论物理、计算机科学和工程学等诸多领域的交叉研究与科学合作带来了契机,也带动了数值相对论模拟中高性能计算 (high-performance computing, HPC) 12 13 14 的爆发以及高吞吐量的数据分析基础设施的发展 15 16。

匹配滤波技术 17,作为 aLIGO 低延迟引力波探测方法中最灵敏的算法,目前是只针对 4D 的波源参数空间(自旋校准分量的准圆轨道致密双星系统) 18 19 20 21 上搜寻信号 (m_1,m_2,s^z_1,s^z_2),这仅是 GW 探测器的 9D 模板参数空间 (m_1,m_2,\vec{s}_1,\vec{s}_2,e) 的子集 22 23 24 25 26。近年来,有研究表明对致密的恒星双星系统来说,基于这样的模板库搜寻方法是不充分的,会遗漏引力波信号 27 25 28 29。所以,将模板依赖的引力波搜寻算法推广到任意自旋过程的准圆轨道或带偏心率的 BBHs 模板 是有必要的,然而这在计算开销上却是令人望而却步的 30。

基于上述的考虑,我们需要一个全新的范式来解决当前引力波探测算法的局限性和计算开销的挑战。一个理想的候选方案就是现在发展快速的深度学习技术。该技术是一个高扩展性的机器学习算法,可以直接从原始数据中学习,并无需做任何人工的特征工程,通过深度层状的“人工神经元”构造神经网络,依靠反向传播和梯度下降等优化算法实现网络模型的学习 31 32。特别是近年来,在 GPUs 等硬件的进步和大数据技术基础上,深度学习已经在诸多商业应用和人工智能 (AI) 31 33 34 35 36 37 38 研究领域中取得了巨大的成功,并已经在天体物理学领域 39 40 41 42 43 44 45 46 内得以应用。

最初,将卷积神经网络用来处理时序序列数据的灵感,可以追溯到深度学习起步的早期阶段 47。自此之后,整个机器学习社区就开始建立了以卷积神经网络为代表的一系列工作,当中数据来源不仅有语音信号 48,也有时频能谱图 49 作为数据表征。可见,由引力波观测所获得的时序数据与它们在原理和数据结构上非常相似的。卷积神经网络尤其在分类或回归任务中表现尤为优异,它们都是将数据的特征空间 \mathbb{R}^d (比如说分辨率有限的图像或一段有限的语音片段)映射到一组有限的标签集合 (分类问题) 或者是一个低维实数向量 (回归问题),由此达到提取特征信息和压缩特征空间维数的效果。

在早先的研究中,将卷积神经网络应用在引力波信号搜寻上的工作都是一个分类学习问题。George 和 Huerta 50 通过模拟 1 秒时长的高斯噪声与一部分描述双黑洞并合系统的引力波信号模板进行混合,如此生成数据集的过程和 PyCBC 51 流水线很类似。在数据集中,对应了并合时间 (coalescence time) 的引力波信号峰值是随机排布在后 0.2 秒时长的范围内。基于该数据集,他们训练了深度神经网络模型,模型输出数据是 0 或 1 来分别表示某 1 秒时长的时序样本中是否含有引力波信号。该模型是需要一个阈值 (threshold) 来把控最终的二分类决策结果。此外,他们还训练了第二个神经网络,用以确定对应的双星系统的一些基本的波源参数。可见,卷积神经网络对于在高斯背景噪声中探测某种非高斯特征是很有效的,这些非高斯性就对应于输入数据中特定的片段中,并且有着比传统机器学习方法优异的表现。

随后,他们也将卷积神经网络方法应用在了真实的 LIGO 数据中,所用到的引力波波源的参数也更加复杂和丰富,比如带有自旋和偏心率不为零的双黑洞系统 50 52。对于时长比较长的数据样本,都会通过滑动切片(sliding-window)的方式将数据切成有重叠的 1 秒时长的时序样本,用以方便输入到神经网络模型中。对于多探测通道的引力波数据来说,会先分别单独切片处理,然后再根据对应的 GPS 时间贴合在一起。尤为重要的是,作者认为他们的引力波探测和参数估计模型与匹配滤波技术相比,在相同的探测灵敏度下,无论是在错误率还是在计算效率上都更胜一筹 52。我们将会在本章中解释这个结果,这对我们理解基于卷积神经的模型的性能度量是很重要的。

Gabbard 等研究者 53 用了一种很类似的方式:同样是包含有卷积层和全连接层的深度神经网络来解决一个二分类学习问题,数据是在对高斯噪声背景下切分为 1 秒时长的模拟引力波信号。然而,他们的研究核心是与匹配滤波技术的对比。他们得出结论其所构造的网络模型与同样在 1 秒时长的样本数据上通过匹配滤波方法搜寻引力波信号的性能灵敏度是可比拟的。在本文的第五章,我们对比了上述研究者 52 53 所构造的算法模型和泛化性能,并提出了结构更简单且性能更加优异的神经网络模型。

另外,范锡龙老师等研究者 54 另辟蹊径地给出了一种不同的处理方法。在他们的方法中,引力波数据输入到卷积神经网络之前,先使用小波分解来预处理数据,使得数据预先体现出了频域表征。他们也运用了滑动切片的办法来统一每个数据样本的时长。不过,他们的结果是基于高斯白噪声的,并且引力波波形是通过模拟的衰减正弦波生成的。

此外,也有一些引力波数据分析的工作是使用 CNN 模型来实现的。比如 glitch 的分类 45 46 49 55 56 和参数估计 57。

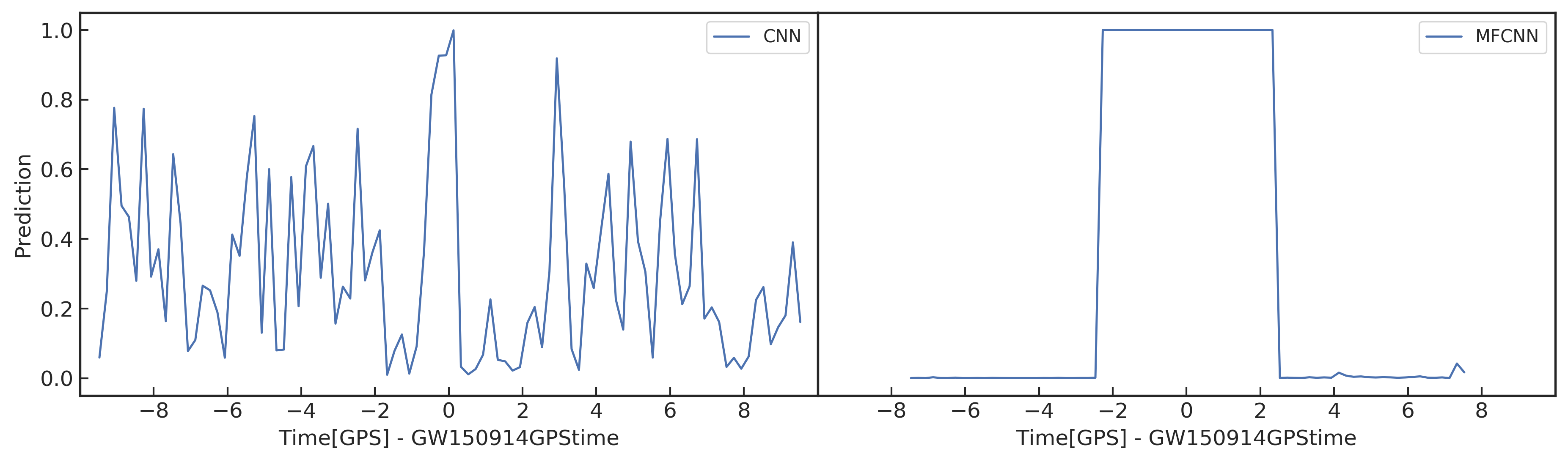

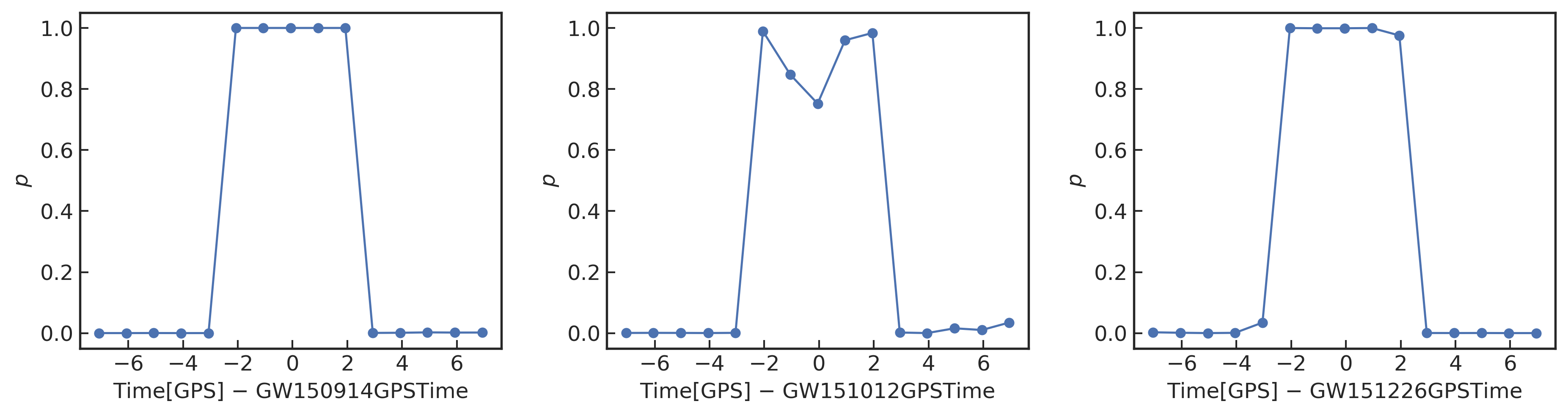

基于对卷积神经网络的理解和目前已有的工作 (第四章和第五章),我们通过结合上述前人的实践经验,将网络结构推广到适用于多探测器引力波数据的情形。我们在真实 LIGO 数据背景上构建卷积神经网络,并验证能否对真实引力波事件有显著的响应。经过反复的实验和调整,我们发现通过固定滑动窗口的方式扫描特定的引力波事件附近的数据,很难清晰的将真实的引力波事件信号识别出来,或者说,与其附近的非高斯噪声误报之间区别开,如下方图中的左图所示。为了解决传统卷积神经网络对真实引力波信号识别的实际难题,我们提出一种假设:卷积特征提取部分的初始参数替换为匹配滤波模板波形,会提升网络模型对真实引力波信号的辨别能力。这是因为匹配滤波算法在本质上是一个很长的模板波形与数据做卷积的过程,对应于网络中一个小卷积核与数据做卷积运算。只要是用正确的波形模板做匹配滤波,就应该能很轻易的识别出信号。所以与其让网络自己学习波形特征,不如直接将标准的波形模板作为其初始化模型参数的特征。正是基于这样的思路,我们构造了全新的卷积神经网络模型(MFCNN),发现确实可以大幅度提高真实引力波信号的辨别能力,如下方图中的右图所示。

GW150914 引力波事件附近 10 秒真实 LIGO 数据分别根据 CNN (左) 和 MFCNN (右) 网络模型的预测结果对比图

我们所构造的全新神经网络框架 58,称其为匹配滤波-卷积神经网络 (Matched-filtering Convolutional Neural Network, MFCNN),它是在一个深度卷积神经网络 59 系统的基础上,部署了一个“匹配滤波”层作为引力波数据的预处理层,它可以直接以原始的引力波时序序列作为分类任务的输入数据,而无需部署额外的数据清理过程。

在本章中,我们将会进一步推广卷积神经网络在真实的 LIGO 噪声背景下来探测 GW 信号。我们将会首次阐述深度学习与匹配滤波技术中重要的数学联系 (第 6.2 节),从而给出神经网络版的信号处理 (白化) 和匹配滤波算法 (第 6.3 节),由此成功构建匹配滤波-卷积神经网络 (第 6.4 节)。深度学习一旦从极少量的匹配模板信号中学习结束后,可以从非常低信噪比的时序信号里,在非高斯非稳态的 LIGO 噪声中实现真实引力波事件探测 (第 6.7 节)。我们的结果证实了 MFCNN 可以在速度提高数个量级的基础上,对一些短噪声源 (如 glitch) 有着非常好的鲁棒性。我们也描述了 MFCNN 是如何处理多探测器中任意长的数据流 (第 6.5 节)。尤为重要的是,本章的工作是相关研究领域中,首次利用深度学习技术成功地探测识别 LIGO 和 Virgo 在 O1 和 O2 上所有公开发布的真实引力波事件。

6.2 时域中的匹配滤波¶

在这一节中,我们将会先简要回顾匹配滤波技术的数学基础 (第 2.4 节)。然后,我们将其从频域改写到时域上来表达。进而阐述清楚神经网络中的卷积运算与匹配滤波之间的关系。基于此,我们可以构建通过卷积神经网络来表达的匹配滤波方法。

根据第二章中第 2.4 节所介绍的匹配滤波技术,我们可以将匹配滤波信噪比的数学表达式,从频域改写为时域上来表达。考虑一个模板信号 h(t) 和某探测器中的时序数据 d(t)。那么匹配滤波信噪比可以通过下面的公式计算:

其中,t_0 是在给定时序数据上 \rho_\text{mf} 的最大值似然所对应的信号到达时间,上式中分子的含时内积可定义为

其中,\tilde{\cdot} 表示傅里叶变换,S_n(|f|) 是关于探测器噪声的单边平均功率谱密度。公式 \eqref{eqn:C6_timemfsnr} 中的分母就是我们在第二章中定义的内积:

根据卷积定理和相关函数与卷积之间的关系,我们可以将公式 \eqref{eqn:C6_timemfsnr_fenzi} 中的白化和频域乘积都改写为时域卷积 (*) 的形式

在上式中,我们已经将白化过程改写为时域卷积的形式:

其中,\bar{S}_n(t) 可以通过如下式的逆傅里叶变换给出

类似地,公式 \eqref{eqn:C6_timemfsnr} 中分母部分的不含时内积函数也可以在时域中表达为:

基于上述在时域上表达的匹配滤波信噪比公式 \eqref{eqn:C6_timemfsnr}, \eqref{eqn:C6_whiten1}, \eqref{eqn:C6_whiten2}, \eqref{eqn:C6_mfconv} 和 \eqref{eqn:C6_fenmu},我们就可以将其进一步改写作卷积神经网络形式的白化滤波 (whitening filter),匹配滤波 (matched filter) 以及归一化滤波 (normalization filter)。

6.3 用于匹配滤波的卷积神经单元¶

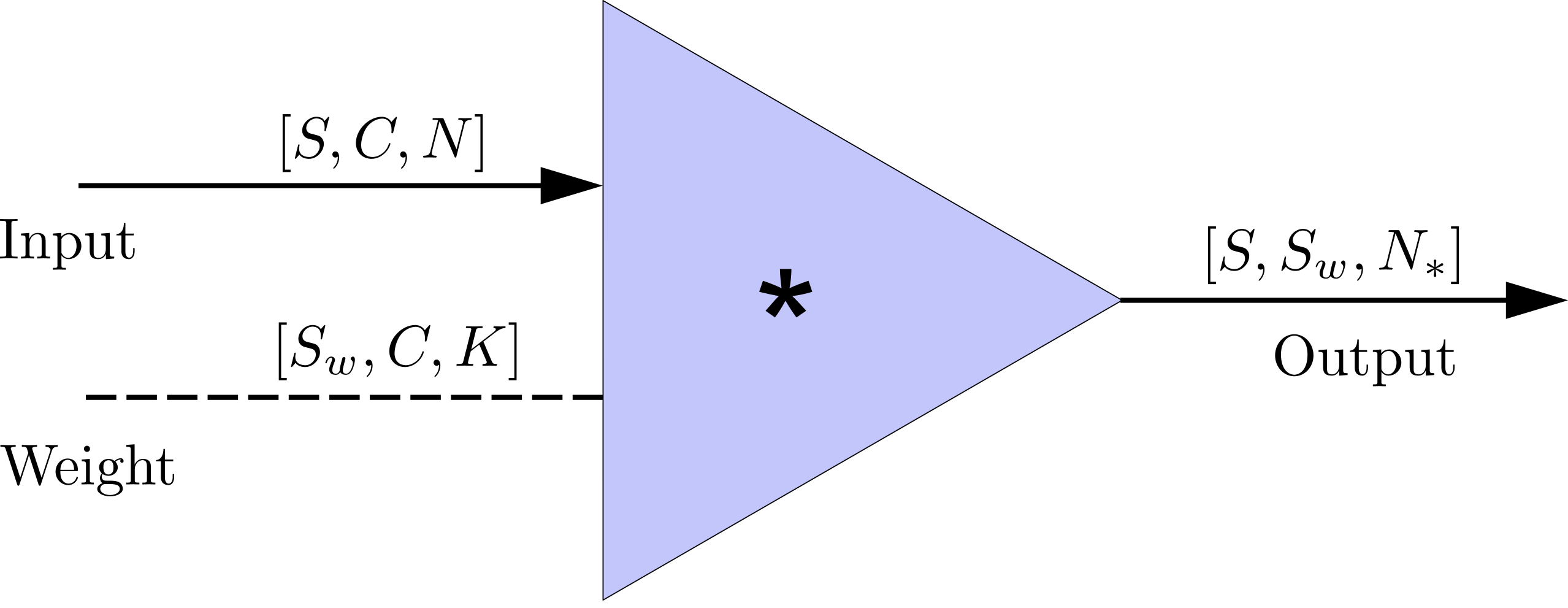

在深度学习的框架下,数据都会通过以多维数组的形式来表示。以一维的时序引力波数据来说,可以表示成三维的数据结构 [S,C,N],其中 S 对应于数据的样本数 (sample),C 对应于多探测器的通道数 (channel),而 N 表示的是数据采样数目 (number),对应于数据长度。由此对于 j\in\{\text{H1,L1}\} 双通道的卷积运算会基于给定的一组输入数据 (input),及其对应的权重参数 (weight),可计算给出相应的输出结果 (output):

其中,* 是深度学习框架中的卷积运算操作,其相当于是在每个通道下并行地做了 S\times S_w 次卷积运算,再将各通道的卷积结果线性加和得到的计算结果。输出数据的长度 N_* 是同时依赖于其输入数据的结构 (input) 和可学习权重参数 (weight) 1 的,

其中,\lfloor\cdot\rfloor 表示向下取整,P 和 S 分别是补零的数目 (padding) 和卷积核移动步长 (stride),详细计算原理可见第 3.4.1 节。我们考虑把上述神经网络的卷积运算看作是平权的两个输入端和一个输出端所构成卷积运算单元,如下图所示。

深度学习框架中一个卷积运算单元的示意图

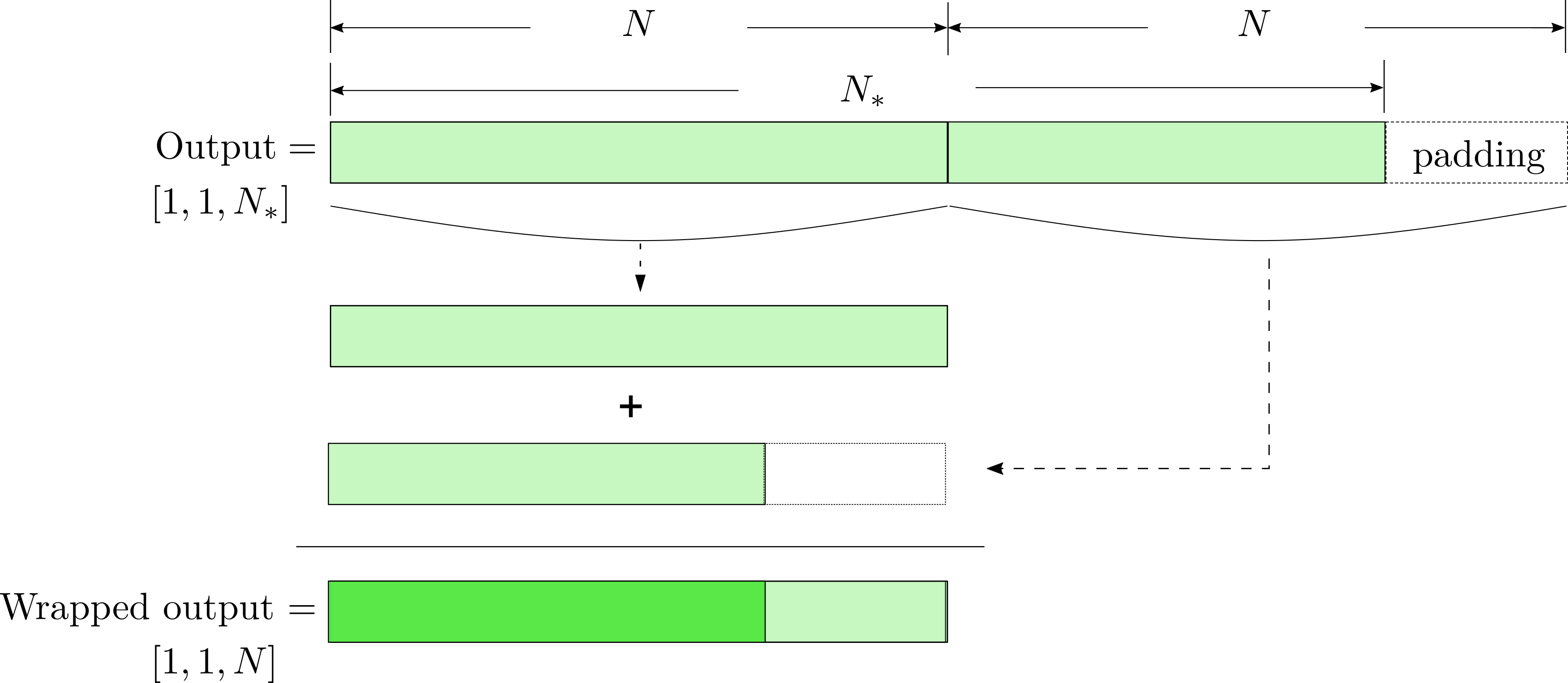

为了像池化层一样在不损失主要特征的前提下,能够压缩输出数据长度从而降低计算的复杂度,我们对卷积运算单元的输出数据执行包裹 (wrapping) 操作,通过 padding 的方式达到目标输出长度的整数倍后,进行折叠和相加,就可以使得输出数据长度与输入数据长度保持一致,如下图所示。该操作相当于是实现了模N的循环卷积 (modulo-N circular convolution) 60。

对卷积运算单元输出数据进行 wrapping 操作的示意图

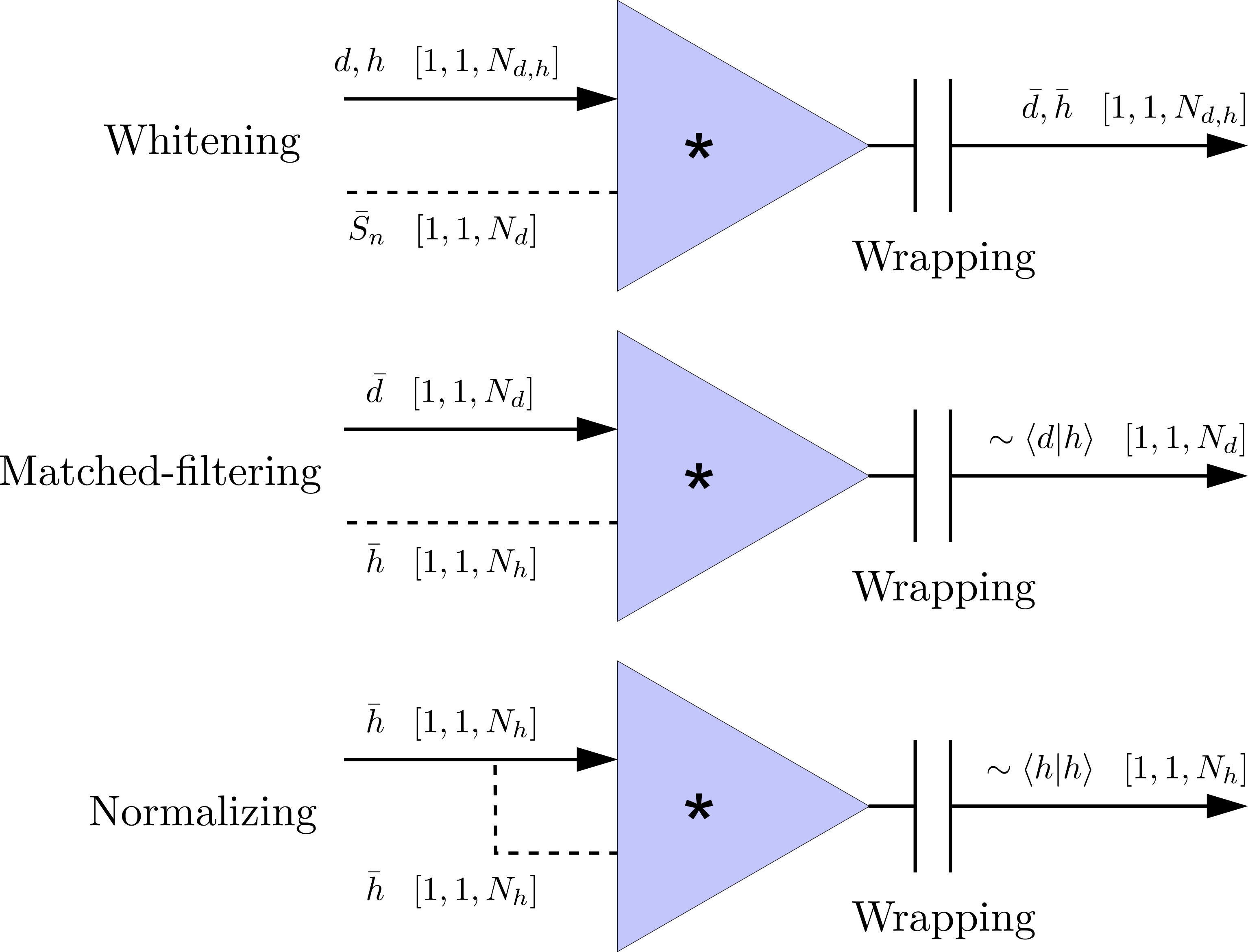

对于单个探测器和某个波形模板来说,我们可以相应地将匹配滤波技术中白化公式 \eqref{eqn:C6_whiten1} 和 \eqref{eqn:C6_whiten2}、匹配滤波公式 \eqref{eqn:C6_mfconv} 和归一化内积公式 \eqref{eqn:C6_fenmu} 用深度学习框架中的卷积运算单元等价表示。假定有一段引力波数据 d\,[1,1,N_d],则白化操作和关于波形模板 h\,[1,1,N_h] 的匹配滤波和归一化可以表示为:

其中,我们用 \omega 来代表 wrapping 操作。我们可以将上式分别改写作深度学习框架下的白化、匹配滤波和归一化的卷积神经单元,其权重参数分别对应为 \bar{S}_n(t)、\bar{h}(t) 和 \bar{h}(t)。并且我们设定卷积运算的 padding 超参数根据对应权重的长度对应为 N-1,N_h-1,N_h-1,以确保其可以实现完整的 Flip-and-slide 卷积模式 (详情可见第 3.4.1 节和第 3.4.4 节)。由此,匹配滤波算法就可以由深度学习框架下的卷积神经单元来构成,如下图所示。

分别对应为白化、匹配滤波和归一化内积的卷积运算单元示意图

6.4 匹配滤波-卷积神经网络(MF-CNN)模型的构造¶

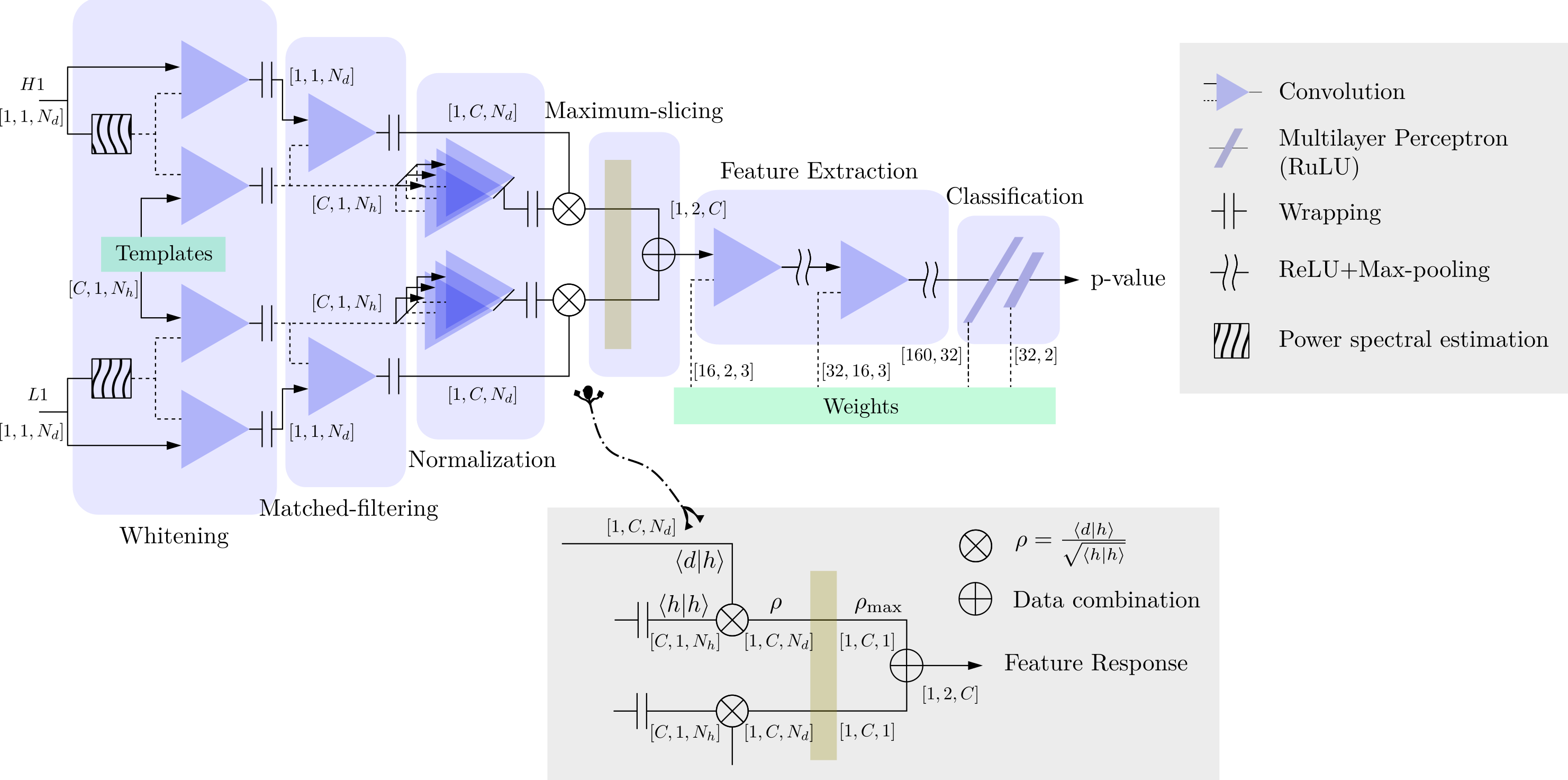

在本节中,我们将基于上节中所定义的白化、匹配滤波和归一化卷积神经单元来构建网络模型,我们称之为匹配滤波-卷积神经网络 (matched-filtering CNN, MF-CNN)。模型的构造总体上分为六个部分相串联,如下图所示。

MFCNN 神经网络结构示意图

上图网络的源代码 (source code)

MFCNN 中的前三个部分分别对应的是白化、匹配滤波和归一化。它们是从匹配滤波算法受到的启发,分别实现了对数据的噪声估计、波形特征匹配和归一化操作。当某一个数据样本输入到网络之前,会先根据不同的探测器频道 (H1/L1) 分成独立的计算数据流。在白化 (Whitening) 阶段,模型需要先根据当前的数据信息估计噪声功率谱作为白化卷积计算单元的权重参数,进而实现对输入数据与 C 个模板的去色操作。在匹配滤波 (Matched-filtering) 阶段,去色后的 C 个模板将会作为网络的权重参数,与去色后的引力波数据分别进行时域卷积计算,其输出的数据结果将会与每个去色后的模板自卷积后输出的归一化 (Normalization) 结果相结合。从计算意义上来说,如此计算得到的结果 \rho 对应于 C 个模板与输入数据信号在各种可能到达时间下的匹配滤波信噪比。

与匹配滤波技术类似,我们在最大化切片 (Maximum-slicing) 部分中取两个探测器频道下每个模板中最大似然的信噪比,作为最佳匹配输出结果,我们称其为特征响应 (Feature Response)。具体来说,我们挑出对应不同模板下特征响应的最大值 \rho_m[1,C,1],作为每个模板的输出特征:

与此同时,我们也可以从各个模板中挑出的最大特征响应 \rho_m[1,C,1] 所对应的信号到达时间 N_0 和相对最佳匹配模板 C_0,

其中,\rho\left[1, C, N_d\right]|_{C_0} 表示从 \rho 的数据结构中取相对最佳匹配模板 C_0 所对应的时域信息。由此,就可以用 \rho[1,C,N_d]|_{C_0,N_0} 来表示对应最佳匹配模板上最大化似然的匹配滤波信噪比。最后,将 H1 和 L1 各自对应的输出结果 \rho_m[1,C,1] 合并成 \rho_m[1,2,C]。它表示某一段时序输入数据对应于 C 个模板分别在 H1 和 L1 探测器上的特征响应。

将特征响应 \rho_m[1,2,C] 作为典型卷积神经网络的输入数据特征,在第五、六部分中进行特征提取 (Feature Extraction) 和分类识别 (Classification)。从图上中可以看到,我们使用了两个卷积层和一个全连接层来判断时序输入中是否存在引力波信号。这样低容量的 CNN 有着较好的泛化能力。从图中还可以留意到,传统的卷积神经网络是如何用上节介绍的卷积神经单元来表达的。值得注意的是,CNN 部分的权重参数是可学习参数,会随着网络模型的迭代优化进行更新。在本文中,为了简化和明确我们的研究问题,波形模板作为卷积的权重参数是不会迭代更新的。

6.5 搜寻疑似引力波信号的策略¶

在实际的引力波信号搜寻过程中(如 O1 和 O2),我们需要对持续时间很长的时序数据流识别和标记疑似引力波信号。以往的由传统 CNN 网络 52 50 53 构建的引力波搜寻算法都是关于二分类的问题。目前二分类模型的基本搜寻策略是通过时序窗口移动的办法来延拓到比较长的时序数据。由于分类器的输入窗口大小都是固定的,所以这就需要引入一个新的额外参数,即滑动窗口的步长。此外,过去的研究都会将模拟信号的峰值放在样本中后部 20% (或本文第四章取居中的80%) 的小范围内进行模型训练和测试实验,并不会覆盖到完整的窗口范围内。因此,无论是滑动窗口的大小还是步长,都对模型的性能度量和信号搜寻效果是有直接影响的,并且也很难解释。比方说,将 “FPR \times 样本的时长 = FP” 是不合理的,因为重叠区域会混淆这个定义。其次,根据所设定的滑动窗口的步长大小,可能会只有部分波形会落在有效的窗口范围内,所以没法确定地将其标记为 0 或 1。而且,也没有对模型输出结果的自然解释。最后,为了确定信号的到达时间,会需要一个很高的时域分辨率 (即很短的时间步长),但这也会带来很高的计算开销。综上,基于滑动窗口的传统 CNN 构建二分类模型是很难有效的应用在流数据上的。

然而,本文所提出的 MFCNN 模型在性能度量和处理流数据上可以较好的克服上述难题。首先,考虑到 MFCNN 模型的前三部分本质上就是在做匹配滤波,所以疑似信号的到达时间落在输入窗口样本的任何范围内,都会在模型中产生一样的特征响应,从而会有一致预测结果。所以整个样本窗口范围都是有效的探测区间。此外,匹配滤波也会根据相对匹配最佳的波形模板输出该疑似引力波信号到达时刻的估计,以及该相对匹配最佳的模板波源参数。可见,MFCNN 模型在信号搜寻上可以借助匹配滤波技术的优势,为后续的数据处理和实验观测提供便利。然而为了简化研究,我们仅考虑在 MFCNN 模型训练完成后,目标是从真实的 LIGO 数据中能够搜寻到包含有引力波事件信号的数据段。

对于本文所提出的 MFCNN 模型,我们采用的信号搜寻策略是:考虑一段 T=5 秒时长的有限时序序列作为模型的输入数据 d,以 1 秒为间隔移动时间窗口在数据流 D 上标记模型预测概率 p。从内积计算公式 \eqref{eqn:C6_timemfsnr_fenzi} 中可以看到,我们需要计算每一段输入数据样本 d 中的功率谱密度 S_n。由于 LIGO 中的噪声有着非稳态的特征,所以采用时长较长的时序数据作为输入来估计 S_n 可以捕获到更一般且稳定的噪声功率背景。然而,时长越长的输入数据也会显著地影响计算效率。考虑到在 LIGO 数据中真实的双黑洞并合事件信号都不足一秒,我们折中选取了 5 秒时长作为模型输入数据的窗口长度,并且在每一次截取的数据窗口之间,我们都在数据流 D 上向前 1 秒来滑动时间窗口,用以获得新的 5 秒输入数据。所以,理论上对于在数据流 D 中某一秒时长的数据,会被截取过五次输入到网络模型中,并给出五个相关的预测概率结果。如果对于模型输出 p 大于某一个给定阈值 p_c,我们的网络模型就会给出一个预警。如果有连续的 5 个以上预警出现,那么就将其视为一个疑似引力波信号。因此,如果我们的模型可以在某一秒的时间段中识别出引力波信号,那么模型就会在该时间区间上有连续 5 次的预警响应。

当确认了某疑似引力波信号后,那么一个很实际的问题就是:引力波信号究竟在预警数据区间段中什么位置。基于我们上述的信号搜寻方法,一个引力波信息是可能埋在连续五个及以上的预警时间区间中。考虑到模型输出的每一次预警判断也对应的是 5 秒的时间区间,我们取某疑似引力波信号所对应的第一个预警区间的最左端时刻和最后一个预警区间的最右端时刻之间的时间区间,以此作为该疑似引力波信号可能存在的预警时间区间。在标记疑似事件的时候,我们会记录下疑似事件的数据区间长度和中间时刻。

基于上述的讨论,我们给出基于模拟信号的模型性能度量方法。对于某测试数据流 D,将所有注入模拟信号的时间区间集合标记为 D_{\mathcal{I}},而其他未注入信号的时间区间集合为 D_{\mathcal{N}}=D-D_{\mathcal{I}}。训练好后的 MFCNN 模型会基于上述的信号搜寻策略,会在数据流 D 上给出所有模拟信号所在的预测时间区间集合,记作 D_{\mathcal{P}}。据此,我们定义正报几率 (true alarm probability, TAP) 和误报几率 (false alarm probability, FAP)

显然上述定义是依赖于阈值 p_c 的,所以通过调整不同的 p_c,我们就可以给出由 TAP 和 FAP 所描述的 ROC 模型性能度量。考虑到在我们定义的模型预测时间区间中,即使是高信噪比的注入模拟信号,模型预测的时间区间会略大于实际注入信号的时间区间,但只要测试数据流足够长,该盈余的预测误差是可以忽略不计的。

6.6 数据准备与模型微调¶

当考虑引力波背景数据时,一般有两种选择:根据探测器设计灵敏度 (ASD) 模拟的高斯有色噪声、以及真实的 LIGO 引力波探测数据 (基于匹配滤波流水线尚未发现任何信号事件的数据)。在前者的稳态背景噪声中 (第五章),频谱分布的波动是均匀且稳定的,并不包含有 glitches。而正如本文第 2.2.3 节中所讨论的,glitch 是实际引力波数据分析中非常重要的噪声来源之一。因此在本章中,我们使用真实的 LIGO 引力波数据来训练和测试模型性能。我们将会从 O1 数据 (来自 GWOSC 61) 中随机地采样背景噪声样本,并且要求采样后的 LIGO 数据满足以下要求:

- H1 和 L1 双探测器同时在线。

- 不包含硬件模拟信号注入(hardware injections) 62

- 不包含真实引力波事件 (GW150914,GW151012,GW151226) 附近的数据。

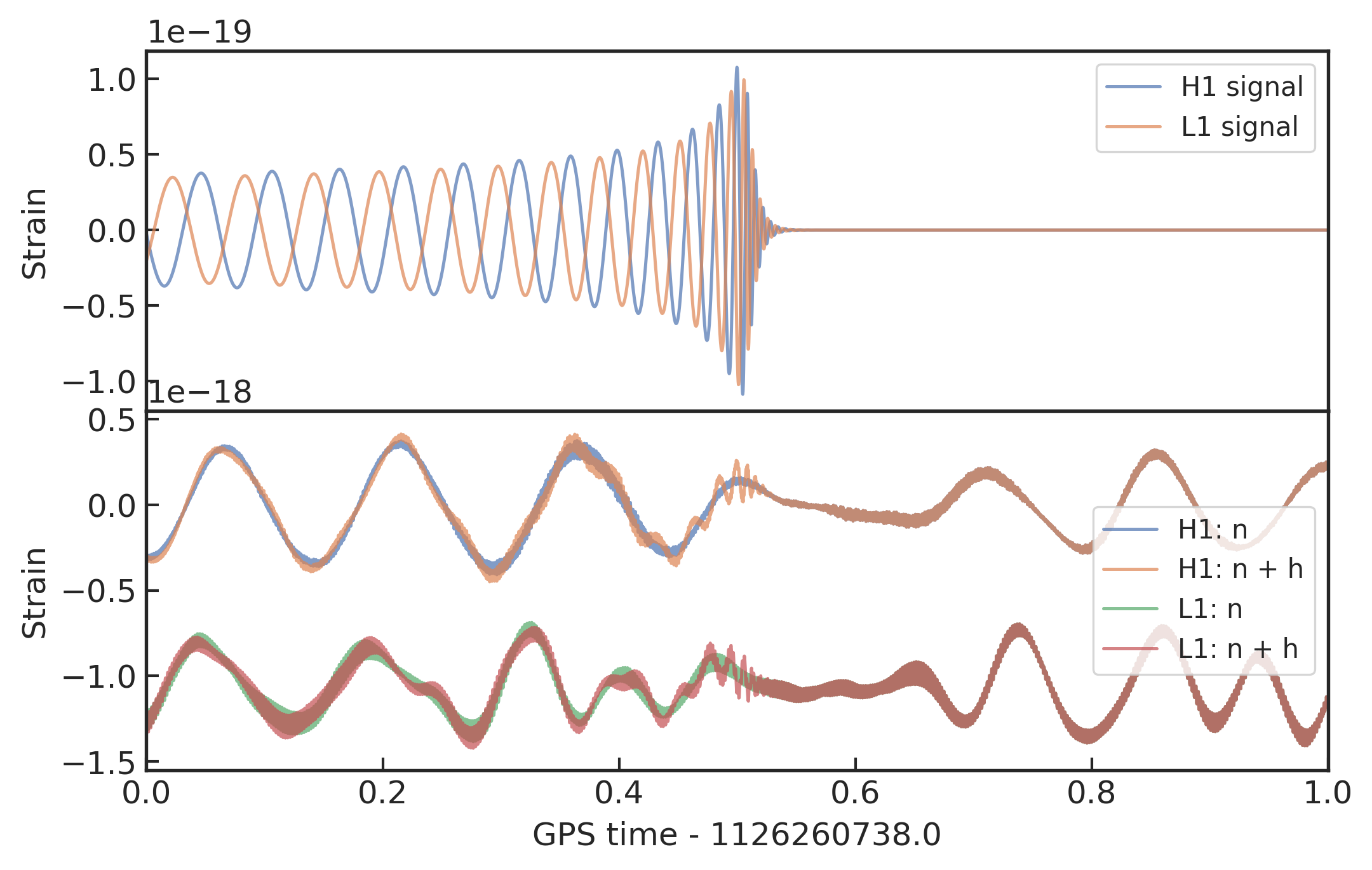

(左) 62.50M_\odot+57.50M_\odot 引力波波形(上)与采样的某段真实引力波数据混合 (\rho_\text{opt}\sim25) 后的训练样本(下)

(右) 训练数据、测试数据、模板波形数据以及 11 个引力波事件波源的质量分布图

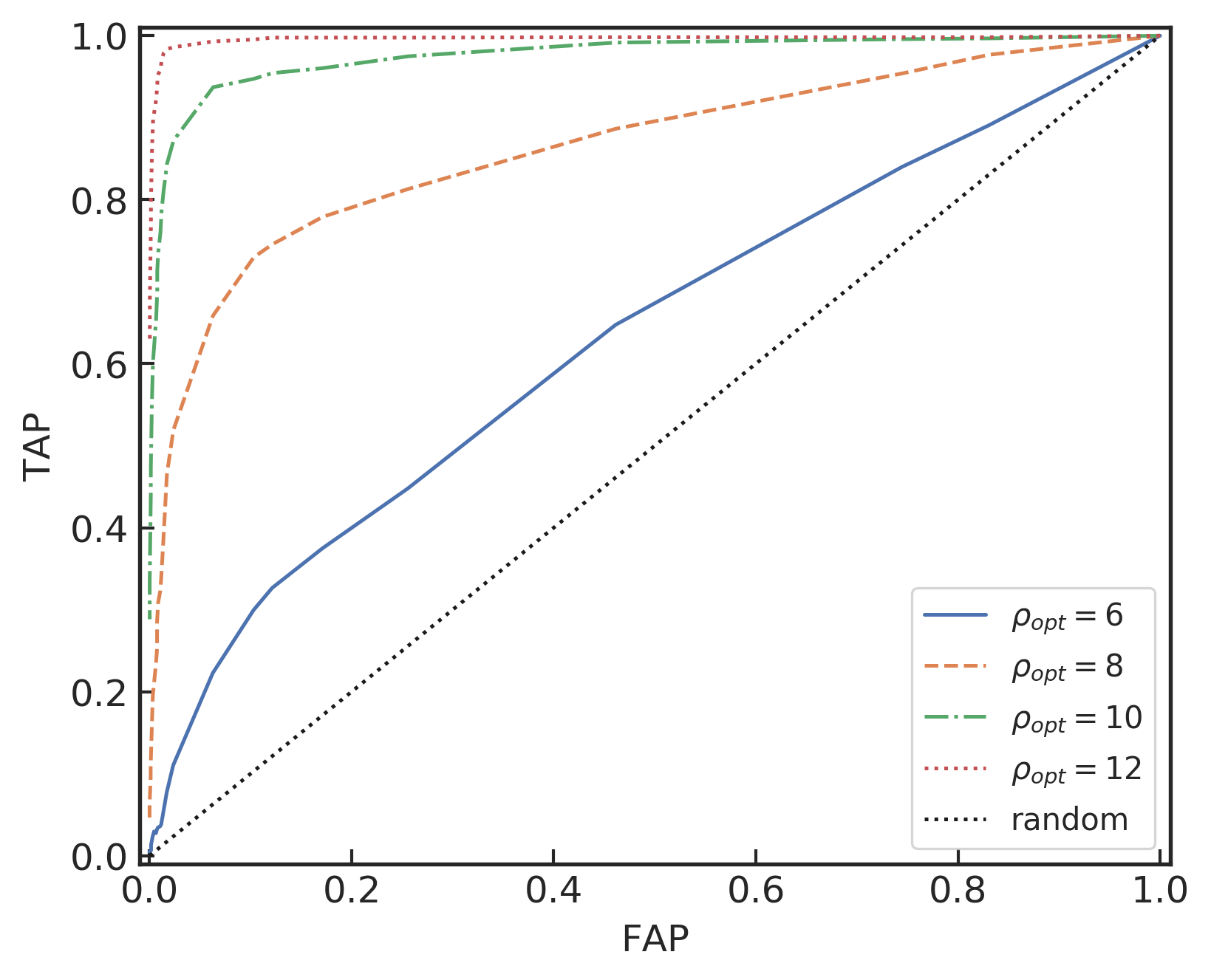

我们使用 SEOBNRE 模型 63 64 生成模拟的引力波波形。与第四章和第五章的波源参数配置一致,本章只考虑准圆周、无自旋的双黑洞并合系统为引力波的波源,共生成训练和测试用的波形模板 3220 个。每个波形样本时长为 5 秒,采样率为 4096Hz。由于模型所具有的匹配滤波特性,我们无需要求波形峰值在样本某区间内随机排布,而是将波形峰值固定在样本数据的居中位置处。关于 LIGO 探测器的方向等参数,我们参考的是 LALSimulation 2 中的默认设定,所以每个数据样本都会对应有两个频道维度,分别对应于 H1 和 L1 两个探测器。考虑到模型本身就包含有白化的数据预处理操作,所以我们的数据样本是直接根据匹配滤波信噪比将模拟信号与真实噪声相混合的,如上方左图所示为某一训练数据样本。在 MFCNN 模型中,我们取等质量比但不同总质量参数的双黑洞并合系统,作为模型内部的匹配滤波模板。为了提高计算效率,要求匹配滤波模板波形的时长为 1 秒。C 作为模型内的波形模板数目,也是模型超参数之一。最后,训练数据集、测试数据集和模板波形 (C=35) 的质量分布,可如上方右图所示。为了方便比较,我们将 O1 和 O2 中 11 个真实的引力波事件也标记在图中。

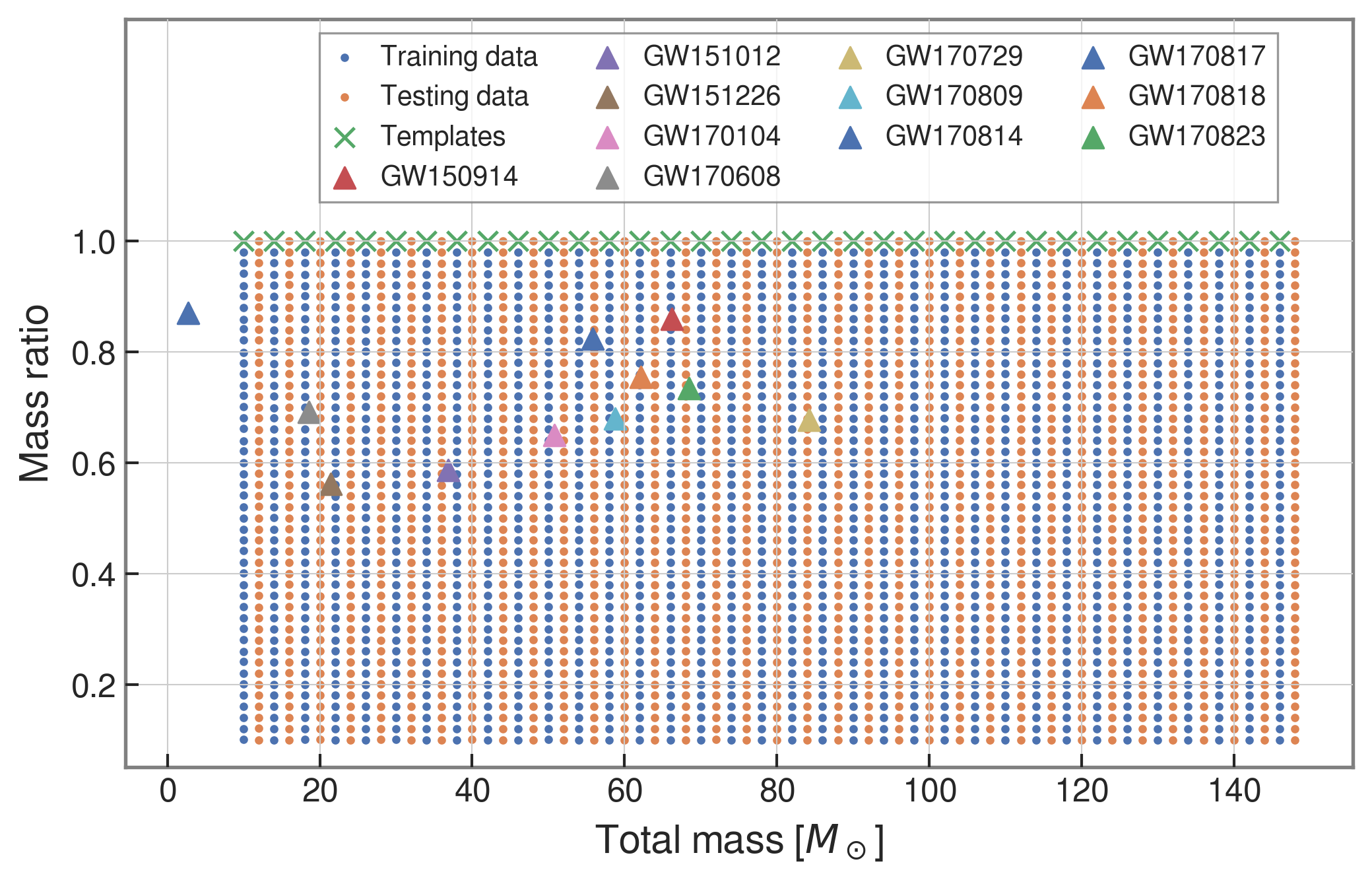

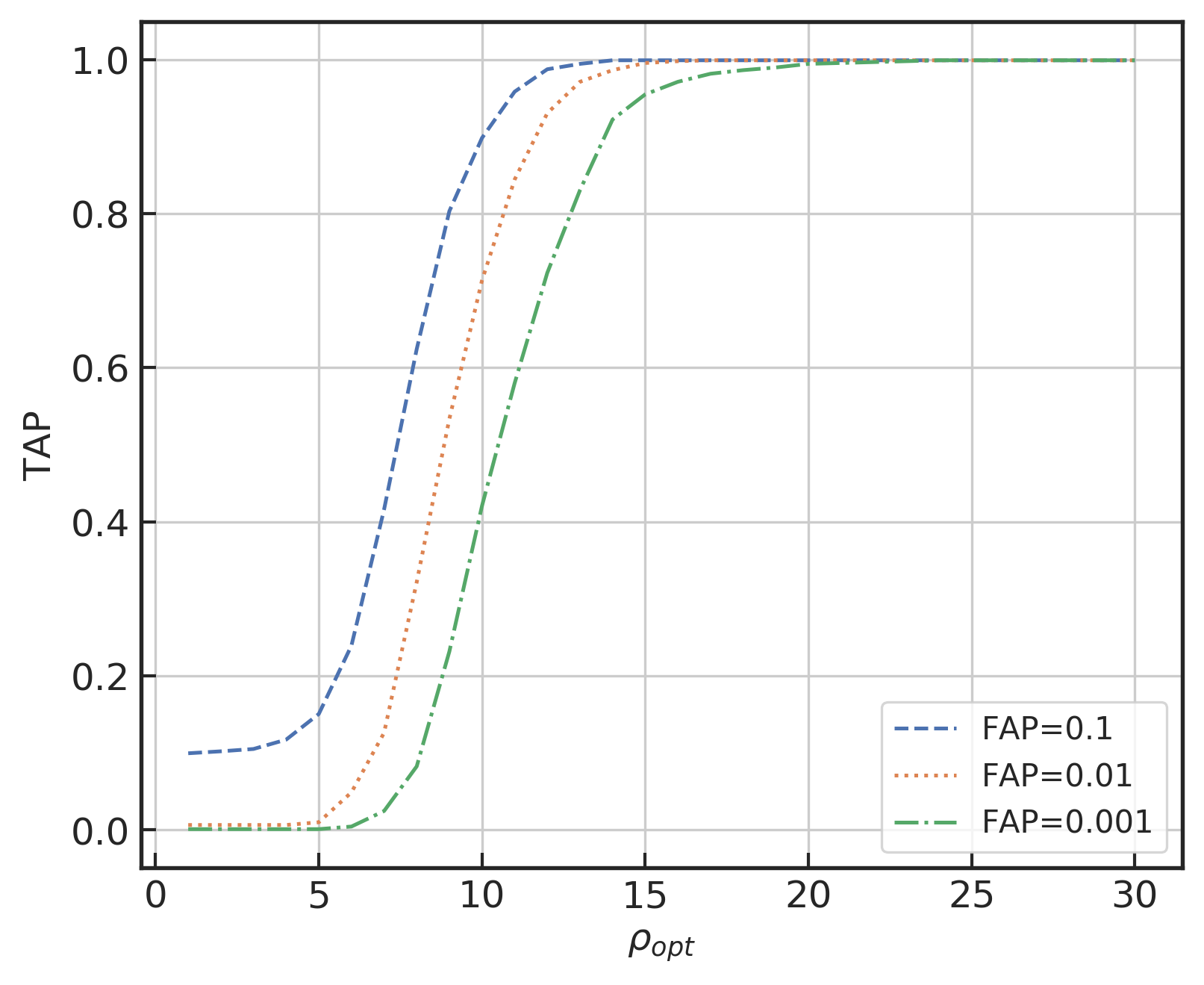

取 p_c=0.5,C=35,

(左) 在 \rho_{opt}=6,8,10,12 测试信号数据下 MFCNN 模型的 ROC 曲线

(右) 分别对应于 \text{FAP}=0.1,0.01,0.001 时 MFCNN 模型关于 \rho_{opt} 的引力波信号识别效率

对 MFCNN 模型的训练策略与第五章是一致的,也会采用逐步降低信噪比的方式来达到训练收敛。模型训练完成后,就可以将其放置在真实引力波数据流中测试模型的性能。我们通过调整不同的匹配滤波信噪比,在 O1 背景噪声中随机注入测试波形信号,就可以给出 MFCNN 模型在其上进行引力波信号搜寻的预测结果。显然,信噪比较高的信号是容易辨识的。如上方左图所示,信噪比较大的测试数据会有明显较好的 ROC 曲线。对于不同信噪比下的引力波信号,TAP 可以用来表示该信号的识别效率 (recognition efficiency)。对于误报几率在 0.1、0.01 和 0.001 时,不同信噪比的模拟信号识别效率曲线,如上方右图所示。

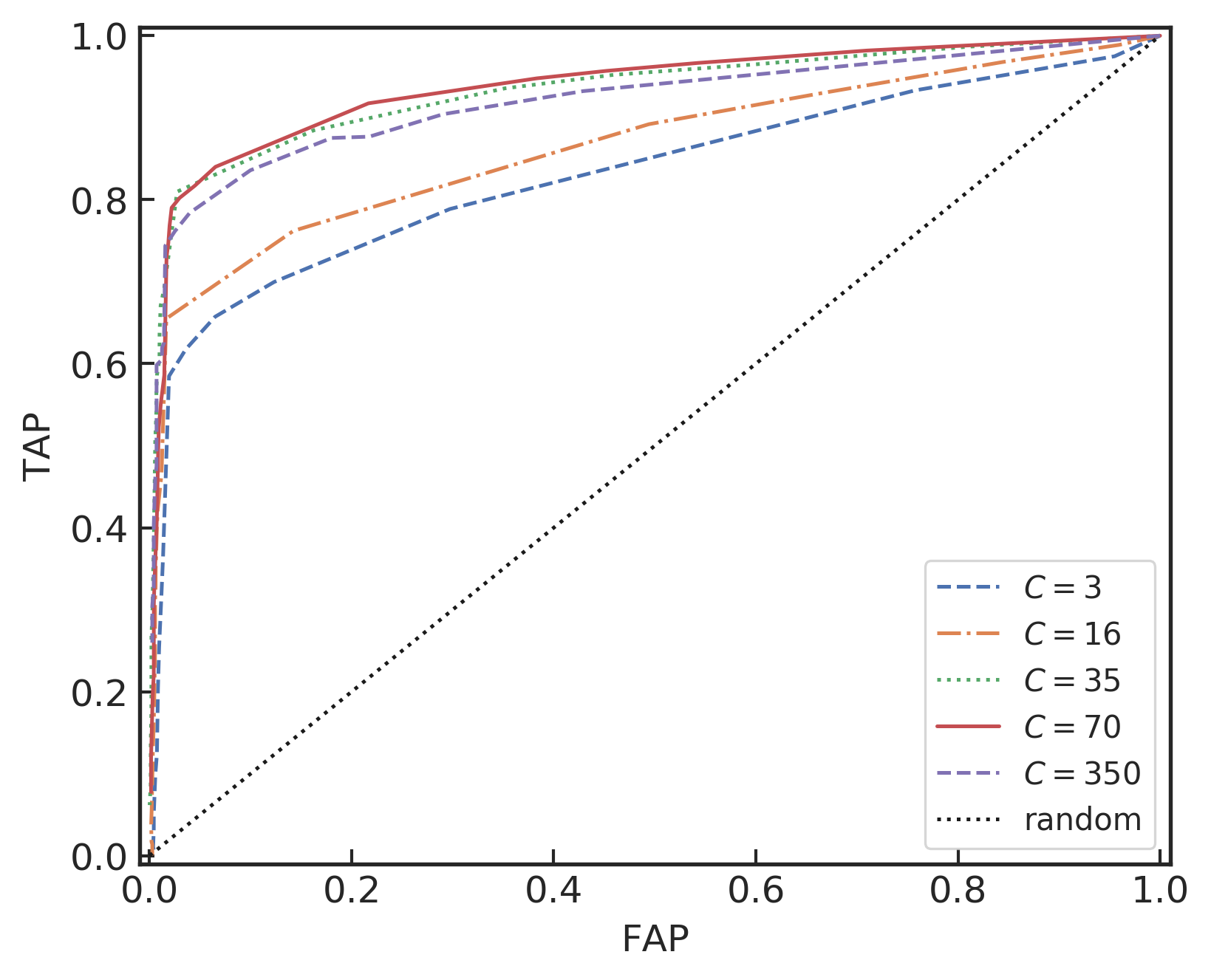

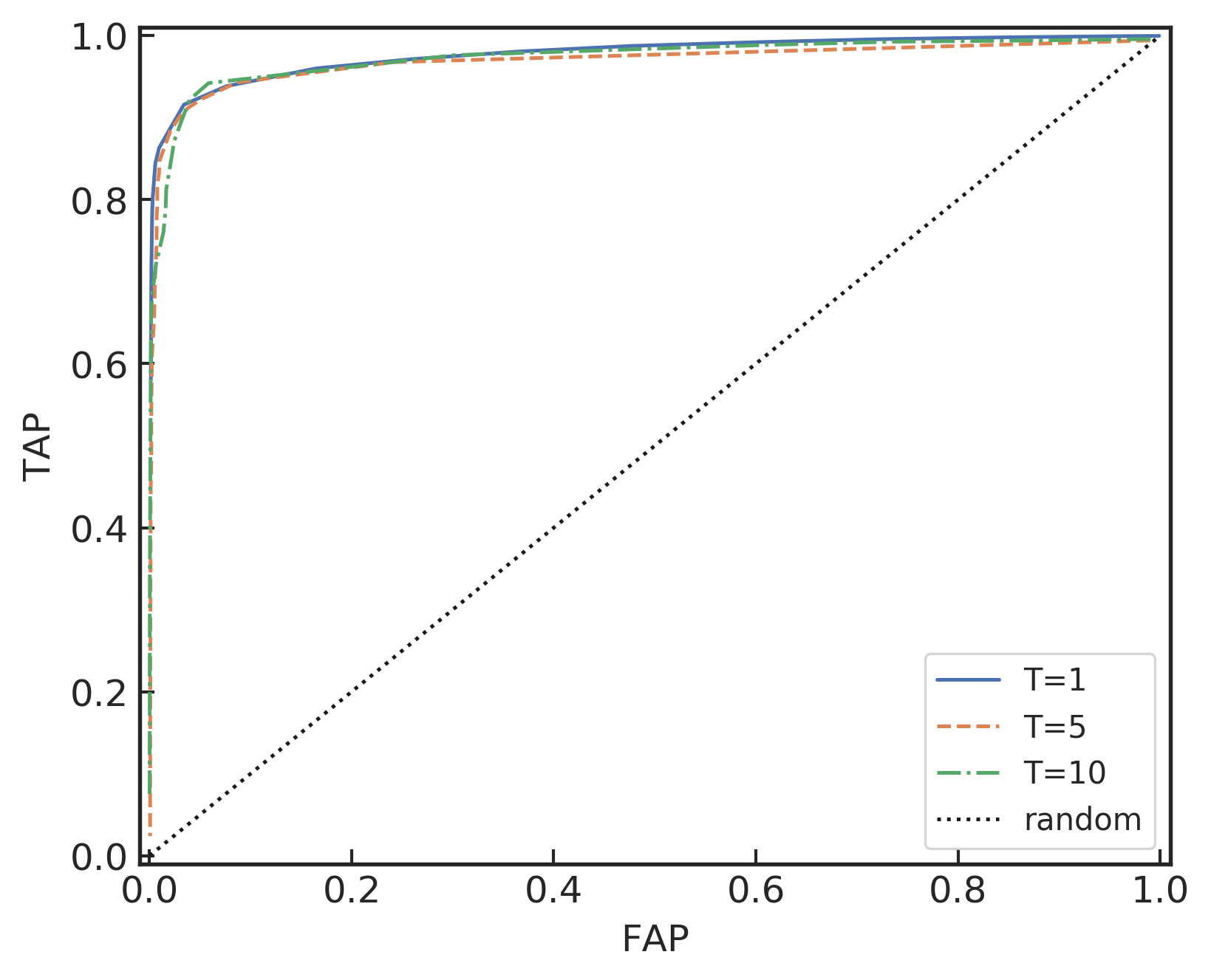

下面我们考察 MFCNN 模型内部匹配滤波模板的数目 C 和输入数据的窗口大小 T 这两个超参数对模型识别性能的影响。我们在 [5,75]M_\odot 范围内均匀选取了不同数目的匹配滤波模板数目 C=3,16,35,70,350 并以此测试模型的泛化性能,如下方左图所示。我们发现即使使用很少量的波形模板 (C=3),MFCNN 模型也依然有着不错的信号识别能力。可以看到,在模板数量大于 20 左右,ROC 曲线的变化就大致不依赖于模板数目这个超参数。因此在本文中,我们默认取 C=35。此外,我们根据输入窗口的大小 T=1,5,10 分别以 0.2,1,2 秒作为滑动间隔并训练 MFCNN 模型。通过连续五次及以上滑动窗口的预警策略来确定疑似信号的预测范围,我们同样道理的可以给出 MFCNN 模型在该测试数据上的 ROC 性能度量,如下方右图所示。从图中可以看到模型的性能表现基本上并不依赖于超参数 T。

MFCNN 网络的超参数微调。

(左) 在 \rho_{opt}=10,T=5 时,对于 C=3,16,35,70,350 的 ROC 曲线

(右) 在 \rho_{opt}=10,C=35 时,对于 T=1,5,10 的 ROC 曲线

6.7 真实 LIGO 引力波数据上的搜寻结果¶

LIGO 的第一次观测运行 (O1) 始于 2015 年 9 月 12 日 00:00 UTC (GPS 时间 1126051217) 至 2016 年 1 月 19 日 16:00 UTC (GPS 时间 1137254417),其中 H1 和 L1 同时在线时间 3 占 42.8%,约 55 天。aLIGO 和 aVirgo 的第二次观测运行 (O2) 始于 2016 年 11 月 30 日 16:00 UTC (GPS 时间 1164556817) 至 2017 年 8 月 25 日 22:00 UTC (GPS 时间 1187733618),其中 H1 和 L1 同时在线时间 4 占 46.4%,约 124 天。起初 LIGO 关于双黑洞并合事件信号搜寻中仅确认了两个引力波事件,分别是 GW150914 和 GW151226,另外还有因置信度不足的一例疑似引力波事件 LVT151012。在 LIGO 和 Virgo 研究团队的合作下,于 2019 年发布了第一份引力波事件官方目录 GWTC-1 65,该目录列出了迄今为止在 O1 和 O2 中检测到的所有引力波事件,其中报告了在之前数据分析中未宣布的四种由黑洞碰撞产生的引力波,由此把确认的双星并合事件的总数变为 11 个,其中就包括由疑似事件转正的 GW151012,还有一例双中子星并合的引力波事件 GW170817。

6.7.1 搜寻 O1 和 O2 中的引力波信号¶

在这一节,我们将 MFCNN 模型应用在 LIGO 真实引力波探测数据上。模型超参数取为 T=5,C=35,同时我们设定阈值 p_c=0.5。从上上左图可以看到,在 \rho_{opt}=10 时对应的正报几率和误报几率分别为 \text{TAP}\approx0.7922,\text{FAP}\approx0.0228。

在 O1 中,确认的引力波事件(GW150914、GW151012 和 GW151226)的模型预测结果

对于某个数据样本,如果模型预测的置信概率 p 大于某个设定的阈值 p>p_c,那么我们的网络模型就会对该样本给一个预警标记。如果有连续 5 个及以上的预警标记,则就视作触发了一个疑似引力波信号。如上图所示,我们绘制了 O1 中三个真实引力波事件 (GW150914,GW151012 和 GW151226) 附近处模型输出的预测结果。可以看到,我们的网络模型能够清晰的将三个引力波事件准确地标记出来。对于联合信噪比 (\rho_\text{pycbc}) 分别高达 23.6 和 13.1 的 GW150914 和 GW151226 来说,都有着理想的五次连续 p=1 的置信预测结果,而在信噪比 9.5 的 GW151012 上模型的置信预测会略微逊色许多,但对于包含有信号的五个连续预警标准下,我们的模型预测结果仍可以确保信噪比最弱的引力波事件 GW151012 的每个预警预测有 p>0.5。

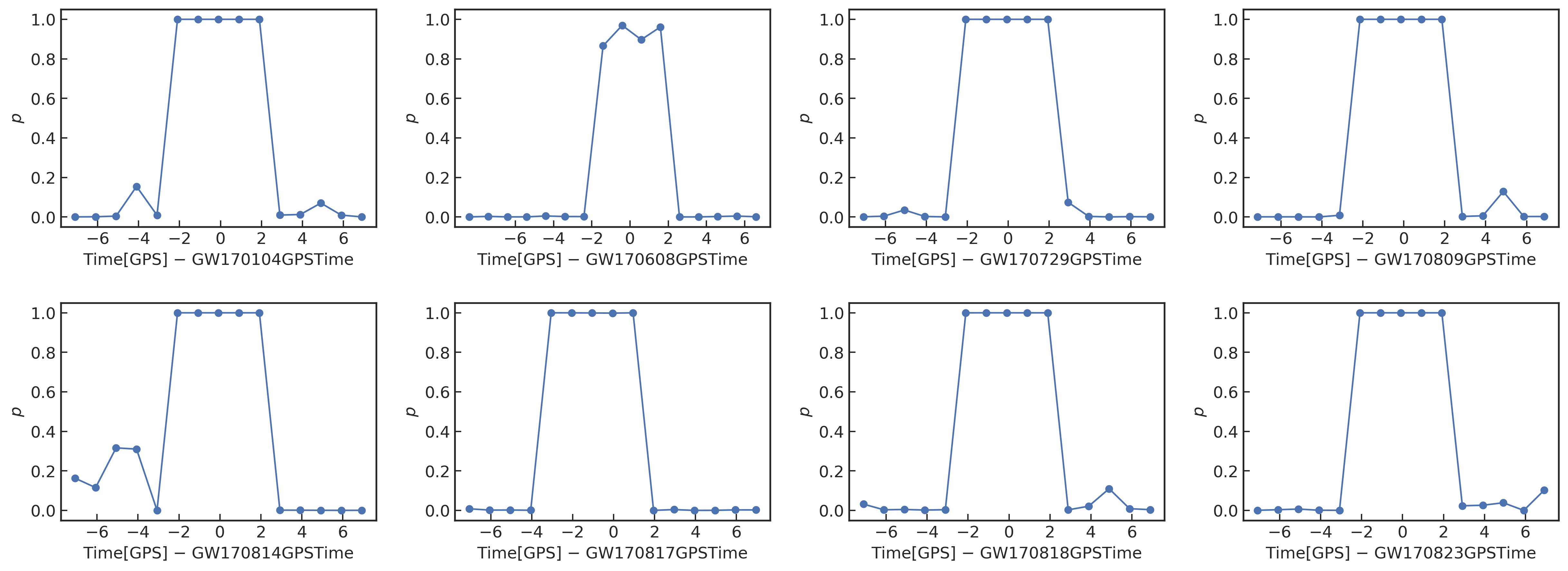

另外一个很有趣的问题就是考察模型在训练和预测的不同噪声背景下,是否可以顺利地将模型识别信号的能力泛化到其他噪声环境中。曾有研究者 66 在 O1 数据上训练神经网络模型后,在 O2 数据上测试其模型的预测响应。与之类似,我们也将 MFCNN 模型直接在 O2 数据中考察其对真实引力波事件的预测结果。如下图所示,引力波数据 O2 中的全部 8 个引力波事件附近的模型预测结果。可以看到所有的真实引力波事件都可以清晰的识别和标记。在 66 的工作中,他们针对双黑洞并合系统所训练的网络模型并没有成功识别到双中子星并合引力波事件 (GW170817)。然而,对于我们的 MFCNN 模型来说,可以非常清晰的将 GW170817 事件辨别出来。值得留意的是,该事件所对应双中子星系统的波源参数并不在我们模型训练集的质量分布范围内,如上上上上右图所示。由此可见,MFCNN 模型在非稳态噪声环境下也有着良好的外插泛化识别能力。

在 O2 中,确认的引力波事件 (GW170104、GW170608、GW170729、GW170809、GW170814、GW170817、GW170818 和 GW170823) 的模型预测结果

除了 O1 上三个确认的引力波事件外,我们还将 MFCNN 模型应用在整个 O1 数据上搜寻疑似引力波信号。在本文中,我们设定阈值 p_c=0.5。如果有超过 5 次连续的模型预测结果并满足 p_c>0.5,我们就会标记该段连续预测结果为一次疑似引力波信号预警。

在不考虑数据质量的情况下,我们在 O1 数据中共找到 3363 个疑似信号 (不包含 GW150914、GW151012 和 GW151226)。在 LIGO 的公开数据中,会为数据标记不同的质量标签。数据被标记为 CBC-CAT3 意味着该段数据中并不包含有已确认的设备环境因素 67 所造成的 glitch 噪声。当我们仅考虑满足数据质量 CBC-CAT3 的 O1 数据后,模型预测共计 2069 个疑似信号。可见,平均而言每 40 分钟会有一个疑似引力波信号。正如在 66 中所谈到的,深度学习方法还无法很好的为每一个疑似信号就统计重要性上进行排序。所以我们很难分清楚这些疑似引力波信号中相互之间的优劣性。我们只能建议对这些疑似引力波信号进一步的数据分析和研究,与之相关的数据信息已经在线上公开 5。

在 GWTC-1 中报告了 O1 数据中新的三个疑似引力波信号,可以从 65 中的表格 II 中查看到其详细数据信息。经过对比,该三个疑似引力波信号并不在我们模型所预测结果当中。68 发布了第一次运行期间的引力波信号目录(1-OGC)。在 68 的表格 I 中罗列了 20 个按误报率(false alarm rate,FAR) 排序的候选引力波信号。其中已确认的三个引力波事件排在该表格前三的位置,其余 17 个候选信号与我们的疑似引力波信号都没有交集。我们还考察了与 \gamma 射线暴 (GRB)所关联的事件 6 的关系。但是并没有任何记录的 GRB 事件与我们所给出的疑似引力波信号有所关联。

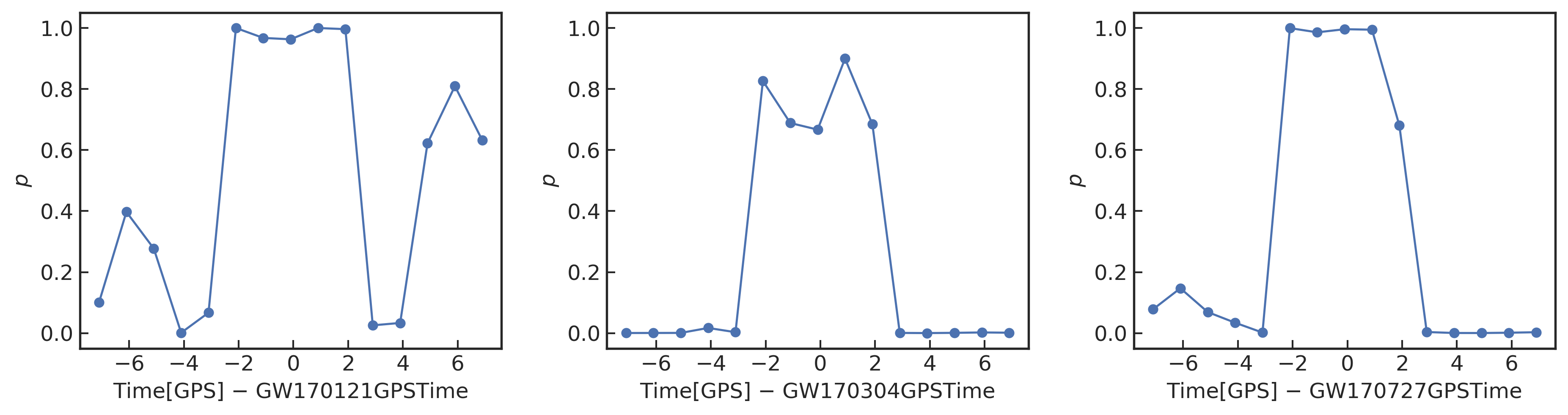

在最近,2-OGC 69 声称在 O2 数据上新确认的引力波事件 GW170121、GW170304 和 GW170727。有趣的是,这些新发现的引力波事件信号也可以在我们的 MFCNN 模型上清晰地被识别并标注出来,如下图所示。

由 2-OGC 发布的引力波事件(GW170121、GW170304 和 GW170727)的模型预测结果

6.7.2 疑似引力波信号的统计特性¶

考虑到 MFCNN 算法模型有着匹配滤波技术所没有的泛化识别能力,所以考察 MFCNN 模型所预测的疑似引力波信号有着怎样统计分布特征是一件很有趣的事情。然而我们仔细地检查了所有的疑似引力波信号与 O1 数据背景在时域、频域和时频域上特征差异,并没有发现任何明显可区分的差别。

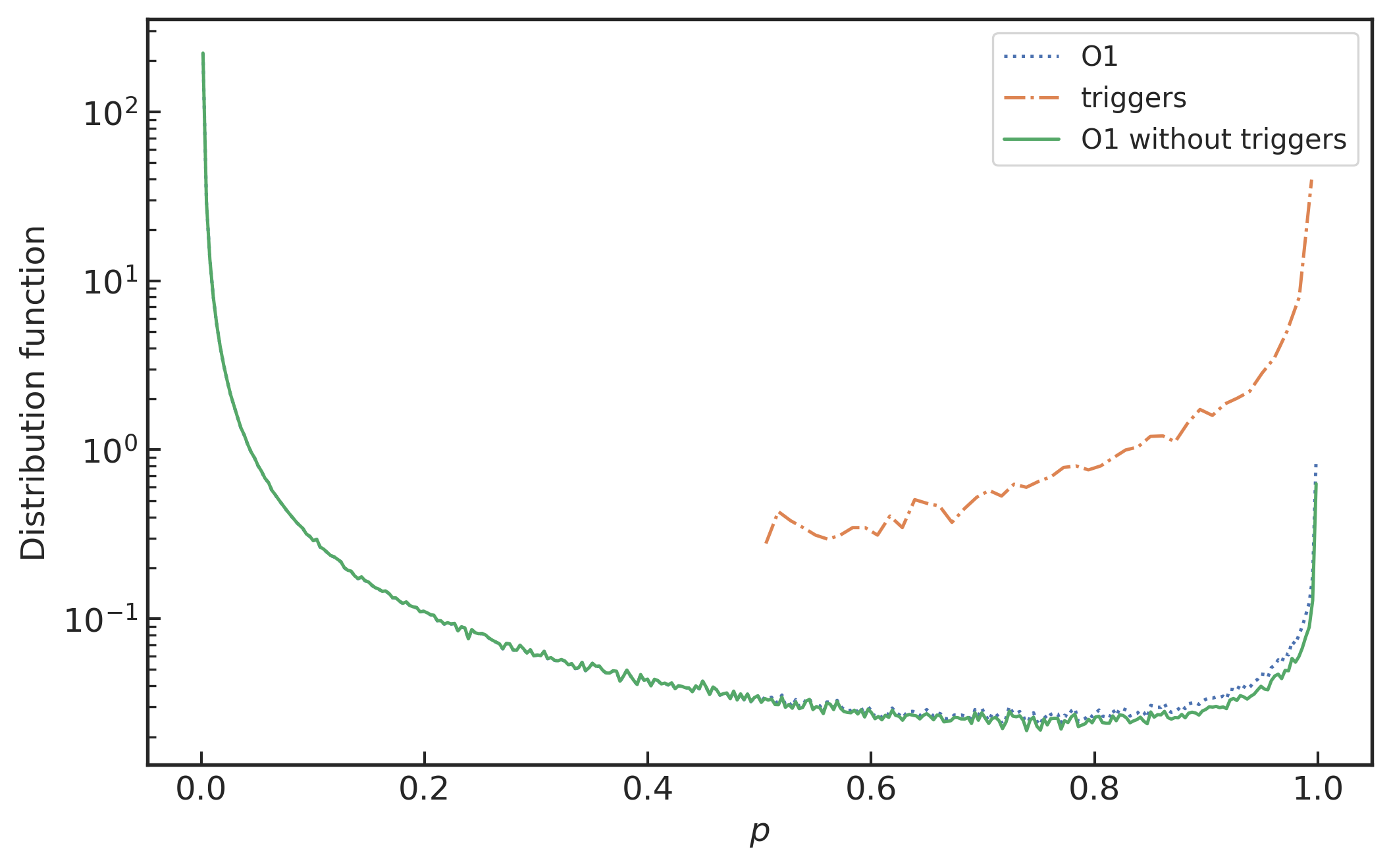

MFCNN 模型的输出预测结果 p 分别关于完整 O1 数据和疑似引力波信号差异之间的对比

基于匹配滤波方法的流水线在提取引力波信号时,误报率是某给定信号置信度的重要衡量指标。粗略地说,误报率反映的是引力波数据中纯噪声的某种统计特性。所以将纯背景噪声与疑似引力波信号的统计特征相互对比是很有意义,比方说 8 的图 4 中所表现的纯噪声与疑似信号之间的统计性差异。尽管 MFCNN 模型并不能提供直接反映噪声统计性的误报率,但是我们依然可以对比纯噪声和疑似信号之间的统计性差异。如上图所示,可以看到疑似信号关于 p 的统计分布与 O1 背景噪声响应之间有着明显的差异,这意味着疑似信号在统计意义上与 O1 数据相比服从不同的统计规律。

6.7.3 引力波信号与 glitch 的统计分析¶

目前在 O1 数据中已探明的 glitches 已在 70 中发布。Glitch 对引力波信号的识别和数据分析的影响是很大的。所以考察 MFCNN 模型对这些 glitches 的筛查情况是很重要的。如上小节中谈到,我们的 MFCNN 模型扫描和处理完整的 O1 数据的时候,并没有考虑 glitch。如果 MFCNN 在搜寻疑似引力波信号时对非高斯的 glitch 噪声报告预警,就意味着我们的网络模型并不能将引力波信号波形与 glitch 噪声波形区分开来。在 70 的公开报告中,O1 数据中共有 7368 个 glitches,其中 812 个落在了我们的疑似引力波信号所划定的预警范围内。这意味着我们的 MFCNN 模型对 glitches 的筛查能力可以达到 \frac{7368-812}{7368}\approx90\%。而且,我们发现 MFCNN 对具有高频、长时和信噪比较高的 glitch 筛查能力要更好。

根据 70 的数据报告,O1 中的 glitches 包含有 Blip、Kor_Fish 等各种不同波形差异的 glitches。我们发现 MFCNN 模型对不同类型 glitch 的辨别能力也是有差别的。我们将 O1 数据中关于不同类型的 glitch 噪声的数目、所占的百分比以及 MFCNN 对其识别的比例总结在下表中。

O1 中不同类型 glitches 的数目和所占的百分比,以及在 MFCNN 模型下的筛查率

6.8 总结与结论¶

近些年来,已有不少研究工作将深度学习技术应用到引力波数据处理当中。然而,绝大多数的工作还仅限于模拟数据中,这既包括模拟的背景噪声,也包括模拟的引力波波形数据。在本章中,我们通过合理地数学改写匹配滤波算法,将其运用在卷积神经网络的结构中,成功地开发和构建出“匹配滤波-卷积神经网络” (MFCNN) 模型,并最终将其应用在完整的真实 LIGO 探测引力波数据中 (O1)。

MFCNN 是根据 O1 中抽样的小部分真实引力波数据作为训练的背景噪声,通过模拟的双星并合系统波源产生的引力波波形作为特征构建的模型。 训练好的 MFCNN 模型不仅可以清晰地探测到 O1 中确认的三个引力波事件,将其直接应用在 O2 数据中的 8 个引力波事件也是可以将它们探测出来。与 66 的工作相比,虽然都可以将网络模型的识别能力泛化从 O1 泛化到 O2 中,但我们的结果指出 MFCNN 不仅可以对模板库中极少量的波形内插泛化,并且还可以泛化到训练数据集之外的新类型信号,所谓外插泛化,可以清晰地标记双中子星并合事件 GW170817。除了 O1 数据中的三个确认的引力波事件外,我们还报告了 2000+ 个疑似引力波信号,以供进一步深入研究和参考。通过与 GWTC-1 65 和1-OGC 68 所报告的疑似引力波信号对比,我们并没有发现任何相符的信号事件,此外也没有任何与 GRB 事件相符的疑似引力波信号。

另外,值得注意的是真实的引力波信号探测是在非稳态非高斯噪声源 glitch 的环境下,可见 glitch 分类和聚类对于 GW 探测器的定标 (characterization) 在未来是尤为重要的 45。我们考察了 O1 中所有已探明的 glitches,发现 MFCNN 模型对非高斯的 glitch 有着优秀的鲁棒性。从理论上来说,深度学习可以学习到 LIGO 探测器中噪声的特征模式,并且可以发展出优于匹配滤波算法的策略,从而适应非高斯噪声的背景环境。

考虑到所有的冗长计算消耗都体现在了深度学习算法的一次训练过程,所以训练时可以用 GPUs 完成繁重的计算量,训练完成后将连续的数据流实时地经由 CPUs 来数据分析和预测结果。由于 MFCNN 可以为每一次预测同时输出相对匹配最佳的模板参数和到达时间,所以将 MFCNN 当作内插泛化模板库的疑似引力波信号预警系统的话,将其部署在现行的引力波数据处理流水线上进行初步估测,可以更加快速和高效的缩小基于引力波模板探测的候选参数空间范围,进而会让现行的流水线用更少的模板和缩小的参数空间来得到更加详尽的参数估计和置信度测量,由此就实现了用最小的计算资源加速引力波在完整信号参数空间上的数据分析。

-

偏置项可以吸收到权重项中。 ↩

-

https://lscsoft.docs.ligo.org/lalsuite/lalsimulation/group__lalsim__detector__strain.html ↩

-

https://www.gw-openscience.org/summary_pages/detector_status/O1/ ↩

-

https://www.gw-openscience.org/summary_pages/detector_status/O2/ ↩

-

J. Aasi and others. Advanced ligo. Class. Quant. Grav., 32:074001, 2015. arXiv:1411.4547, doi:10.1088/0264-9381/32/7/074001. ↩

-

B. P. Abbott and others. Observation of gravitational waves from a binary black hole merger. Phys. Rev. Lett., 1166:061102, 2016. arXiv:1602.03837, doi:10.1103/PhysRevLett.116.061102. ↩↩

-

B. P. Abbott and others. Gw151226: observation of gravitational waves from a 22-solar-mass binary black hole coalescence. Phys. Rev. Lett., 11624:241103, 2016. arXiv:1606.04855, doi:10.1103/PhysRevLett.116.241103. ↩

-

Benjamin P. Abbott and others. Gw170104: observation of a 50-solar-mass binary black hole coalescence at redshift 0.2. Phys. Rev. Lett., 11822:221101, 2017. arXiv:1706.01812, doi:10.1103/PhysRevLett.118.221101. ↩

-

B. P. Abbott and others. Gw170814: a three-detector observation of gravitational waves from a binary black hole coalescence. Phys. Rev. Lett., 11914:141101, 2017. arXiv:1709.09660, doi:10.1103/PhysRevLett.119.141101. ↩

-

Albert Einstein. The field equations of gravitation. Sitzungsber. Preuss. Akad. Wiss. Berlin Math\. Phys\., 1915:844–847, 1915. ↩

-

B. P. Abbott and others. Directly comparing gw150914 with numerical solutions of einstein’s equations for binary black hole coalescence. Phys. Rev., D946:064035, 2016. arXiv:1606.01262, doi:10.1103/PhysRevD.94.064035. ↩

-

Samantha A. Usman and others. The pycbc search for gravitational waves from compact binary coalescence. Class. Quant. Grav., 3321:215004, 2016. arXiv:1508.02357, doi:10.1088/0264-9381/33/21/215004. ↩

-

E. A. Huerta and others. Boss-ldg: a novel computational framework that brings together blue waters, open science grid, shifter and the ligo data grid to accelerate gravitational wave discovery. In Proceedings, 13th International Conference on e-Science: Auckland, New Zealand, October 24-27, 2017, 335–344. 2017. arXiv:1709.08767, doi:10.1109/eScience.2017.47. ↩

-

Derek Weitzel, Brian Bockelman, Duncan A. Brown, Peter Couvares, Frank Würthwein, and Edgar Fajardo Hernandez. Data access for ligo on the osg. arXiv, 2017. arXiv:1705.06202, doi:10.1145/3093338.3093363. ↩

-

Benjamin J. Owen and B. S. Sathyaprakash. Matched filtering of gravitational waves from inspiraling compact binaries: computational cost and template placement. Phys. Rev., D60:022002, 1999. arXiv:gr-qc/9808076, doi:10.1103/PhysRevD.60.022002. ↩

-

Davide Gerosa, Michael Kesden, Emanuele Berti, Richard O’Shaughnessy, and Ulrich Sperhake. Resonant-plane locking and spin alignment in stellar-mass black-hole binaries: a diagnostic of compact-binary formation. Phys. Rev., D87:104028, 2013. arXiv:1302.4442, doi:10.1103/PhysRevD.87.104028. ↩

-

Carl L. Rodriguez, Sourav Chatterjee, and Frederic A. Rasio. Binary black hole mergers from globular clusters: masses, merger rates, and the impact of stellar evolution. Phys. Rev., D938:084029, 2016. arXiv:1602.02444, doi:10.1103/PhysRevD.93.084029. ↩

-

Carl L. Rodriguez, Meagan Morscher, Bharath Pattabiraman, Sourav Chatterjee, Carl-Johan Haster, and Frederic A. Rasio. Binary black hole mergers from globular clusters: implications for advanced ligo. Phys. Rev. Lett., 1155:051101, 2015. [Erratum: Phys. Rev. Lett.116,no.2,0299012016]. arXiv:1505.00792, doi:10.1103/PhysRevLett.116.029901, 10.1103/PhysRevLett.115.051101. ↩

-

E. A. Huerta, Gabrielle Allen, Igor Andreoni, Javier M. Antelis, Etienne Bachelet, G. Bruce Berriman, Federica B. Bianco, Rahul Biswas, Matias Carrasco Kind, Kyle Chard, Minsik Cho, Philip S. Cowperthwaite, Zachariah B. Etienne, Maya Fishbach, Francisco Forster, Daniel George, Tom Gibbs, Matthew Graham, William Gropp, Robert Gruendl, Anushri Gupta, Roland Haas, Sarah Habib, Elise Jennings, Margaret W. G. Johnson, Erik Katsavounidis, Daniel S. Katz, Asad Khan, Volodymyr Kindratenko, William T. C. Kramer, Xin Liu, Ashish Mahabal, Zsuzsa Marka, Kenton McHenry, J. M. Miller, Claudia Moreno, M. S. Neubauer, Steve Oberlin, Alexander R. Olivas, Donald Petravick, Adam Rebei, Shawn Rosofsky, Milton Ruiz, Aaron Saxton, Bernard F. Schutz, Alex Schwing, Ed Seidel, Stuart L. Shapiro, Hongyu Shen, Yue Shen, Leo P. Singer, Brigitta M. Sipocz, Lunan Sun, John Towns, Antonios Tsokaros, Wei Wei, Jack Wells, Timothy J. Williams, Jinjun Xiong, and Zhizhen Zhao. Enabling real-time multi-messenger astrophysics discoveries with deep learning. Nature Rev. Phys., 110:600–608, October 2019. arXiv:1911.11779, doi:10.1038/s42254-019-0097-4. ↩

-

Fabio Antonini, Sourav Chatterjee, Carl L. Rodriguez, Meagan Morscher, Bharath Pattabiraman, Vicky Kalogera, and Frederic A. Rasio. Black hole mergers and blue stragglers from hierarchical triples formed in globular clusters. Astrophys. J., 8162:65, 2016. arXiv:1509.05080, doi:10.3847/0004-637X/816/2/65. ↩

-

Smadar Naoz, Bence Kocsis, Abraham Loeb, and Nicolas Yunes. Resonant post-newtonian eccentricity excitation in hierarchical three-body systems. Astrophys. J., 773:187, 2013. arXiv:1206.4316, doi:10.1088/0004-637X/773/2/187. ↩

-

Johan Samsing, Morgan MacLeod, and Enrico Ramirez-Ruiz. The formation of eccentric compact binary inspirals and the role of gravitational wave emission in binary-single stellar encounters. Astrophys. J., 784:71, 2014. arXiv:1308.2964, doi:10.1088/0004-637X/784/1/71. ↩

-

E. A. Huerta and others. Complete waveform model for compact binaries on eccentric orbits. Phys. Rev., D952:024038, 2017. arXiv:1609.05933, doi:10.1103/PhysRevD.95.024038. ↩↩

-

Luis Lehner and Frans Pretorius. Numerical relativity and astrophysics. Ann. Rev. Astron. Astrophys., 52:661–694, 2014. arXiv:1405.4840, doi:10.1146/annurev-astro-081913-040031. ↩

-

S. Klimenko and others. Method for detection and reconstruction of gravitational wave transients with networks of advanced detectors. Phys. Rev., D934:042004, 2016. arXiv:1511.05999, doi:10.1103/PhysRevD.93.042004. ↩

-

E. A. Huerta, Prayush Kumar, Sean T. McWilliams, Richard O’Shaughnessy, and Nicolás Yunes. Accurate and efficient waveforms for compact binaries on eccentric orbits. Phys. Rev., D908:084016, 2014. arXiv:1408.3406, doi:10.1103/PhysRevD.90.084016. ↩

-

E. A. Huerta and Duncan A. Brown. Effect of eccentricity on binary neutron star searches in advanced ligo. Phys. Rev., D8712:127501, 2013. arXiv:1301.1895, doi:10.1103/PhysRevD.87.127501. ↩

-

Ian Harry, Stephen Privitera, Alejandro Bohé, and Alessandra Buonanno. Searching for gravitational waves from compact binaries with precessing spins. Phys. Rev., D942:024012, 2016. arXiv:1603.02444, doi:10.1103/PhysRevD.94.024012. ↩

-

Yann LeCun, Yoshua Bengio, and Geoffrey Hinton. Deep learning. nature, 5217553:436–444, 2015. ↩↩

-

Ian Goodfellow, Yoshua Bengio, and Aaron Courville. Deep Learning. Adaptive Computation and Machine Learning series. The MIT Press, 2016. ISBN 9780262337373. URL: https://www.amazon.com/Deep-Learning-Adaptive-Computation-Machine-ebook/dp/B01MRVFGX4?SubscriptionId=AKIAIOBINVZYXZQZ2U3A&tag=chimbori05-20&linkCode=xm2&camp=2025&creative=165953&creativeASIN=B01MRVFGX4. ↩

-

Jürgen Schmidhuber. Deep learning in neural networks: an overview. Neural Networks, 61:85–117, 2015. URL: http://www.sciencedirect.com/science/article/pii/S0893608014002135, doi:10.1016/j.neunet.2014.09.003. ↩

-

Andre Esteva, Brett Kuprel, Roberto A. Novoa, Justin Ko, Susan M. Swetter, Helen M. Blau, and Sebastian Thrun. Dermatologist-level classification of skin cancer with deep neural networks. Nature, 5427639:115–118, February 2017. doi:10.1038/nature21056. ↩

-

David Silver, Julian Schrittwieser, Karen Simonyan, Ioannis Antonoglou, Aja Huang, Arthur Guez, Thomas Hubert, Lucas Baker, Matthew Lai, Adrian Bolton, Yutian Chen, Timothy Lillicrap, Fan Hui, Laurent Sifre, George van den Driessche, Thore Graepel, and Demis Hassabis. Mastering the game of go without human knowledge. Nature, 5507676:354–359, October 2017. doi:10.1038/nature24270. ↩

-

Matej Moravčík, Martin Schmid, Neil Burch, Viliam Lisý, Dustin Morrill, Nolan Bard, Trevor Davis, Kevin Waugh, Michael Johanson, and Michael Bowling. Deepstack: expert-level artificial intelligence in heads-up no-limit poker. Science, 3566337:508–513, 2017. URL: https://science.sciencemag.org/content/356/6337/508, arXiv:https://science.sciencemag.org/content/356/6337/508.full.pdf, doi:10.1126/science.aam6960. ↩

-

Aaron van den Oord, Sander Dieleman, Heiga Zen, Karen Simonyan, Oriol Vinyals, Alex Graves, Nal Kalchbrenner, Andrew Senior, and Koray Kavukcuoglu. Wavenet: a generative model for raw audio. arXiv, 2016. arXiv:1609.03499. ↩

-

Timothy J. O’Shea, Johnathan Corgan, and T. Charles Clancy. Convolutional radio modulation recognition networks. In Chrisina Jayne and Lazaros Iliadis, editors, Engineering Applications of Neural Networks, 213–226. Cham, 2016. Springer International Publishing. ↩

-

Yashar D. Hezaveh, Laurence Perreault Levasseur, and Philip J. Marshall. Fast automated analysis of strong gravitational lenses with convolutional neural networks. Nature, 548:555–557, 2017. arXiv:1708.08842, doi:10.1038/nature23463. ↩

-

Trisha A. Hinners, Kevin Tat, and Rachel Thorp. Machine learning techniques for stellar light curve classification. The Astronomical Journal, 1561:7, June 2018. doi:10.3847/1538-3881/aac16d. ↩

-

Nima Sedaghat and Ashish Mahabal. Effective image differencing with convnets for real-time transient hunting. arXiv, October 2017. arXiv:1710.01422v1, doi:10.1093/mnras/sty613. ↩

-

Kyle A. Pearson, Leon Palafox, and Caitlin A. Griffith. Searching for exoplanets using artificial intelligence. arXiv, June 2017. arXiv:1706.04319v2, doi:10.1093/mnras/stx2761. ↩

-

Sascha Caron, Germán A. Gómez-Vargas, Luc Hendriks, and Roberto Ruiz de Austri. Analyzing γ-rays of the galactic center with deep learning. Journal of Cosmology and Astroparticle Physics, Volume 2018, May 2018, August 2017. arXiv:1708.06706v2, doi:10.1088/1475-7516/2018/05/058. ↩

-

Daniel George, Hongyu Shen, and E. A. Huerta. Classification and unsupervised clustering of ligo data with deep transfer learning. Phys. Rev., D9710:101501, 2018. doi:10.1103/PhysRevD.97.101501. ↩

-

Michael Zevin, Scott Coughlin, Sara Bahaadini, Emre Besler, Neda Rohani, Sarah Allen, Miriam Cabero, Kevin Crowston, Aggelos K. Katsaggelos, Shane L. Larson, Tae Kyoung Lee, Chris Lintott, Tyson B. Littenberg, Andrew Lundgren, Carsten Oesterlund, Joshua R. Smith, Laura Trouille, and Vicky Kalogera. Gravity spy: integrating advanced ligo detector characterization, machine learning, and citizen science. Class. Quantum Grav. 34 2017 064003 22pp, November 2016. arXiv:1611.04596v2, doi:10.1088/1361-6382/aa5cea. ↩↩↩

-

Sara Bahaadini, Neda Rohani, Scott Coughlin, Michael Zevin, Vicky Kalogera, and Aggelos K. Katsaggelos. Deep multi-view models for glitch classification. In 2017 IEEE International Conference on Acoustics, Speech and Signal Processing ICASSP, 2931–2935. 2017. arXiv:1705.00034, doi:10.1109/ICASSP.2017.7952693. ↩↩

-

Yann LeCun and Yoshua Bengio. Convolutional networks for images, speech, and time series. The handbook of brain theory and neural networks, 336110:255–258, 1995. ↩

-

Elena Cuoco, Massimiliano Razzano, and Andrei Utina. Wavelet-based classification of transient signals for gravitational wave detectors. 2018 26th European Signal Processing Conference EUSIPCO, pages 2648–2652, 2018. doi:10.23919/EUSIPCO.2018.8553393. ↩

-

Massimiliano Razzano and Elena Cuoco. Image-based deep learning for classification of noise transients in gravitational wave detectors. arXiv, March 2018. arXiv:1803.09933v1. ↩↩

-

Daniel George and E. A. Huerta. Deep neural networks to enable real-time multimessenger astrophysics. Phys. Rev., D974:044039, 2018. arXiv:1701.00008, doi:10.1103/PhysRevD.97.044039. ↩↩↩

-

Alex Nitz, Ian Harry, Duncan Brown, Christopher M. Biwer, Josh Willis, Tito Dal Canton, Collin Capano, Larne Pekowsky, Thomas Dent, Andrew R. Williamson, Soumi De, Gareth Davies, Miriam Cabero, Duncan Macleod, Bernd Machenschalk, Steven Reyes, Prayush Kumar, Thomas Massinger, Francesco Pannarale, Dfinstad, Márton Tápai, Stephen Fairhurst, Sebastian Khan, Leo Singer, Sumit Kumar, Alex Nielsen, Shasvath, Idorrington92, Amber Lenon, and Hunter Gabbard. Gwastro/pycbc: pycbc release v1.15.4. 2020. doi:10.5281/ZENODO.596388. ↩

-

Daniel George and E. A. Huerta. Deep learning for real-time gravitational wave detection and parameter estimation: results with advanced ligo data. Phys. Lett., B778:64–70, 2018. arXiv:1711.03121, doi:10.1016/j.physletb.2017.12.053. ↩↩↩↩

-

Hunter Gabbard, Michael Williams, Fergus Hayes, and Chris Messenger. Matching matched filtering with deep networks for gravitational-wave astronomy. Physical review letters, 12014:141103, December 2018. arXiv:1712.06041v2, doi:10.1103/physrevlett.120.141103. ↩↩↩

-

Xiangru Li, Woliang Yu, and Xilong Fan. A method of detecting gravitational wave based on time-frequency analysis and convolutional neural networks. arXiv, 2017. arXiv:1712.00356. ↩

-

S. Bahaadini, V. Noroozi, N. Rohani, S. Coughlin, M. Zevin, J. R. Smith, V. Kalogera, and A. Katsaggelos. Machine learning for gravity spy: glitch classification and dataset. Information Sciences, 444:172–186, May 2018. doi:10.1016/j.ins.2018.02.068. ↩

-

S. B. Coughlin, S. Bahaadini, N. Rohani, M. Zevin, O. Patane, M. Harandi, C. Jackson, V. Noroozi, S. Allen, J. Areeda, M. W. Coughlin, P. Ruiz, C. P. L. Berry, K. Crowston, A. K. Katsaggelos, A. Lundgren, C. Osterlund, J. R. Smith, L. Trouille, and V. Kalogera. Classifying the unknown: discovering novel gravitational-wave detector glitches using similarity learning. arXiv, March 2019. arXiv:1903.04058v1. ↩

-

Hongyu Shen, E. A. Huerta, and Zhizhen Zhao. Deep learning at scale for gravitational wave parameter estimation of binary black hole mergers. arXiv, March 2019. arXiv:1903.01998v1. ↩

-

He Wang, Shichao Wu, Zhoujian Cao, Xiaolin Liu, and Jian-Yang Zhu. Gravitational-wave signal recognition of LIGO data by deep learning. Physical Review D, May 2020. arXiv:1909.13442, doi:10.1103/physrevd.101.104003. ↩

-

Y. Lecun, L. Bottou, Y. Bengio, and P. Haffner. Gradient-based learning applied to document recognition. Proceedings of the IEEE, 8611:2278–2324, November 1998. doi:10.1109/5.726791. ↩

-

Sophocles J. Orfanidis. Introduction to Signal Processing. Prentice-Hall, Inc., USA, 1995. ISBN 0132091720. ↩

-

Michele Vallisneri, Jonah Kanner, Roy Williams, Alan Weinstein, and Branson Stephens. The ligo open science center. J. Phys. Conf. Ser., 6101:012021, 2015. arXiv:1410.4839, doi:10.1088/1742-6596/610/1/012021. ↩

-

C. Biwer and others. Validating gravitational-wave detections: the advanced ligo hardware injection system. Phys. Rev., D956:062002, 2017. arXiv:1612.07864, doi:10.1103/PhysRevD.95.062002. ↩

-

Zhoujian Cao and Wen-Biao Han. Waveform model for an eccentric binary black hole based on the effective-one-body-numerical-relativity formalism. Phys. Rev., D964:044028, 2017. arXiv:1708.00166, doi:10.1103/PhysRevD.96.044028. ↩

-

Hsing-Po Pan, Chun-Yu Lin, Zhoujian Cao, and Hwei-Jang Yo. Accuracy of source localization for eccentric inspiraling binary mergers using a ground-based detector network. Phys. Rev., D10012:124003, 2019. arXiv:1912.04455, doi:10.1103/PhysRevD.100.124003. ↩

-

The L. I. G. O. Scientific Collaboration, the Virgo Collaboration, B. P. Abbott, R. Abbott, T. D. Abbott, S. Abraham, F. Acernese, K. Ackley, C. Adams, R. X. Adhikari, V. B. Adya, C. Affeldt, M. Agathos, K. Agatsuma, N. Aggarwal, O. D. Aguiar, L. Aiello, A. Ain, P. Ajith, G. Allen, A. Allocca, M. A. Aloy, P. A. Altin, A. Amato, A. Ananyeva, S. B. Anderson, W. G. Anderson, S. V. Angelova, S. Antier, S. Appert, K. Arai, M. C. Araya, J. S. Areeda, M. Arène, N. Arnaud, K. G. Arun, S. Ascenzi, G. Ashton, S. M. Aston, P. Astone, F. Aubin, P. Aufmuth, K. AultONeal, C. Austin, V. Avendano, A. Avila-Alvarez, S. Babak, P. Bacon, F. Badaracco, M. K. M. Bader, S. Bae, P. T. Baker, F. Baldaccini, G. Ballardin, S. W. Ballmer, S. Banagiri, J. C. Barayoga, S. E. Barclay, B. C. Barish, D. Barker, K. Barkett, S. Barnum, F. Barone, B. Barr, L. Barsotti, M. Barsuglia, D. Barta, J. Bartlett, I. Bartos, R. Bassiri, A. Basti, M. Bawaj, J. C. Bayley, M. Bazzan, B. Bécsy, M. Bejger, I. Belahcene, A. S. Bell, D. Beniwal, B. K. Berger, G. Bergmann, S. Bernuzzi, J. J. Bero, C. P. L. Berry, D. Bersanetti, A. Bertolini, J. Betzwieser, R. Bhandare, J. Bidler, I. A. Bilenko, S. A. Bilgili, G. Billingsley, J. Birch, R. Birney, O. Birnholtz, S. Biscans, S. Biscoveanu, A. Bisht, M. Bitossi, M. A. Bizouard, J. K. Blackburn, J. Blackman, C. D. Blair, D. G. Blair, R. M. Blair, S. Bloemen, N. Bode, M. Boer, Y. Boetzel, G. Bogaert, F. Bondu, E. Bonilla, R. Bonnand, P. Booker, B. A. Boom, C. D. Booth, R. Bork, V. Boschi, S. Bose, K. Bossie, V. Bossilkov, J. Bosveld, Y. Bouffanais, A. Bozzi, C. Bradaschia, P. R. Brady, A. Bramley, M. Branchesi, J. E. Brau, T. Briant, J. H. Briggs, F. Brighenti, A. Brillet, M. Brinkmann, V. Brisson, P. Brockill, A. F. Brooks, D. D. Brown, S. Brunett, A. Buikema, T. Bulik, H. J. Bulten, A. Buonanno, D. Buskulic, M. J. Bustamante Rosell, C. Buy, R. L. Byer, M. Cabero, L. Cadonati, G. Cagnoli, C. Cahillane, J. Calderón Bustillo, T. A. Callister, E. Calloni, J. B. Camp, W. A. Campbell, M. Canepa, K. C. Cannon, H. Cao, J. Cao, E. Capocasa, F. Carbognani, S. Caride, M. F. Carney, G. Carullo, J. Casanueva Diaz, C. Casentini, S. Caudill, M. Cavaglià, F. Cavalier, R. Cavalieri, G. Cella, P. Cerdá-Durán, G. Cerretani, E. Cesarini, O. Chaibi, K. Chakravarti, S. J. Chamberlin, M. Chan, S. Chao, P. Charlton, E. A. Chase, E. Chassande-Mottin, D. Chatterjee, M. Chaturvedi, K. Chatziioannou, B. D. Cheeseboro, H. Y. Chen, X. Chen, Y. Chen, H. P. Cheng, C. K. Cheong, H. Y. Chia, A. Chincarini, A. Chiummo, G. Cho, H. S. Cho, M. Cho, N. Christensen, Q. Chu, S. Chua, K. W. Chung, S. Chung, G. Ciani, A. A. Ciobanu, R. Ciolfi, F. Cipriano, A. Cirone, F. Clara, J. A. Clark, P. Clearwater, F. Cleva, C. Cocchieri, E. Coccia, P. F. Cohadon, D. Cohen, R. Colgan, M. Colleoni, C. G. Collette, C. Collins, L. R. Cominsky, M. Constancio Jr., L. Conti, S. J. Cooper, P. Corban, T. R. Corbitt, I. Cordero-Carrión, K. R. Corley, N. Cornish, A. Corsi, S. Cortese, C. A. Costa, R. Cotesta, M. W. Coughlin, S. B. Coughlin, J. P. Coulon, S. T. Countryman, P. Couvares, P. B. Covas, E. E. Cowan, D. M. Coward, M. J. Cowart, D. C. Coyne, R. Coyne, J. D. E. Creighton, T. D. Creighton, J. Cripe, M. Croquette, S. G. Crowder, T. J. Cullen, A. Cumming, L. Cunningham, E. Cuoco, T. Dal Canton, G. Dálya, S. L. Danilishin, S. D’Antonio, K. Danzmann, A. Dasgupta, C. F. Da Silva Costa, L. E. H. Datrier, V. Dattilo, I. Dave, M. Davier, D. Davis, E. J. Daw, D. DeBra, M. Deenadayalan, J. Degallaix, M. De Laurentis, S. Deléglise, W. Del Pozzo, L. M. DeMarchi, N. Demos, T. Dent, R. De Pietri, J. Derby, R. De Rosa, C. De Rossi, R. DeSalvo, O. de Varona, S. Dhurandhar, M. C. Díaz, T. Dietrich, L. Di Fiore, M. Di Giovanni, T. Di Girolamo, A. Di Lieto, B. Ding, S. Di Pace, I. Di Palma, F. Di Renzo, A. Dmitriev, Z. Doctor, F. Donovan, K. L. Dooley, S. Doravari, I. Dorrington, T. P. Downes, M. Drago, J. C. Driggers, Z. Du, J. G. Ducoin, P. Dupej, S. E. Dwyer, P. J. Easter, T. B. Edo, M. C. Edwards, A. Effler, P. Ehrens, J. Eichholz, S. S. Eikenberry, M. Eisenmann, R. A. Eisenstein, R. C. Essick, H. Estelles, D. Estevez, Z. B. Etienne, T. Etzel, M. Evans, T. M. Evans, V. Fafone, H. Fair, S. Fairhurst, X. Fan, S. Farinon, B. Farr, W. M. Farr, E. J. Fauchon-Jones, M. Favata, M. Fays, M. Fazio, C. Fee, J. Feicht, M. M. Fejer, F. Feng, A. Fernandez-Galiana, I. Ferrante, E. C. Ferreira, T. A. Ferreira, F. Ferrini, F. Fidecaro, I. Fiori, D. Fiorucci, M. Fishbach, R. P. Fisher, J. M. Fishner, M. Fitz-Axen, R. Flaminio, M. Fletcher, E. Flynn, H. Fong, J. A. Font, P. W. F. Forsyth, J. D. Fournier, S. Frasca, F. Frasconi, Z. Frei, A. Freise, R. Frey, V. Frey, P. Fritschel, V. V. Frolov, P. Fulda, M. Fyffe, H. A. Gabbard, B. U. Gadre, S. M. Gaebel, J. R. Gair, L. Gammaitoni, M. R. Ganija, S. G. Gaonkar, A. Garcia, C. García-Quirós, F. Garufi, B. Gateley, S. Gaudio, G. Gaur, V. Gayathri, G. Gemme, E. Genin, A. Gennai, D. George, J. George, L. Gergely, V. Germain, S. Ghonge, Abhirup Ghosh, Archisman Ghosh, S. Ghosh, B. Giacomazzo, J. A. Giaime, K. D. Giardina, A. Giazotto, K. Gill, G. Giordano, L. Glover, P. Godwin, E. Goetz, R. Goetz, B. Goncharov, G. González, J. M. Gonzalez Castro, A. Gopakumar, M. L. Gorodetsky, S. E. Gossan, M. Gosselin, R. Gouaty, A. Grado, C. Graef, M. Granata, A. Grant, S. Gras, P. Grassia, C. Gray, R. Gray, G. Greco, A. C. Green, R. Green, E. M. Gretarsson, P. Groot, H. Grote, S. Grunewald, P. Gruning, G. M. Guidi, H. K. Gulati, Y. Guo, A. Gupta, M. K. Gupta, E. K. Gustafson, R. Gustafson, L. Haegel, O. Halim, B. R. Hall, E. D. Hall, E. Z. Hamilton, G. Hammond, M. Haney, M. M. Hanke, J. Hanks, C. Hanna, M. D. Hannam, O. A. Hannuksela, J. Hanson, T. Hardwick, K. Haris, J. Harms, G. M. Harry, I. W. Harry, C. J. Haster, K. Haughian, F. J. Hayes, J. Healy, A. Heidmann, M. C. Heintze, H. Heitmann, P. Hello, G. Hemming, M. Hendry, I. S. Heng, J. Hennig, A. W. Heptonstall, Francisco Hernandez Vivanco, M. Heurs, S. Hild, T. Hinderer, D. Hoak, S. Hochheim, D. Hofman, A. M. Holgado, N. A. Holland, K. Holt, D. E. Holz, P. Hopkins, C. Horst, J. Hough, E. J. Howell, C. G. Hoy, A. Hreibi, Y. Huang, E. A. Huerta, D. Huet, B. Hughey, M. Hulko, S. Husa, S. H. Huttner, T. Huynh-Dinh, B. Idzkowski, A. Iess, C. Ingram, R. Inta, G. Intini, B. Irwin, H. N. Isa, J. M. Isac, M. Isi, B. R. Iyer, K. Izumi, T. Jacqmin, S. J. Jadhav, K. Jani, N. N. Janthalur, P. Jaranowski, A. C. Jenkins, J. Jiang, D. S. Johnson, N. K. Johnson-McDaniel, A. W. Jones, D. I. Jones, R. Jones, R. J. G. Jonker, L. Ju, J. Junker, C. V. Kalaghatgi, V. Kalogera, B. Kamai, S. Kandhasamy, G. Kang, J. B. Kanner, S. J. Kapadia, S. Karki, K. S. Karvinen, R. Kashyap, M. Kasprzack, S. Katsanevas, E. Katsavounidis, W. Katzman, S. Kaufer, K. Kawabe, N. V. Keerthana, F. Kéfélian, D. Keitel, R. Kennedy, J. S. Key, F. Y. Khalili, H. Khan, I. Khan, S. Khan, Z. Khan, E. A. Khazanov, M. Khursheed, N. Kijbunchoo, Chunglee Kim, J. C. Kim, K. Kim, W. Kim, W. S. Kim, Y. M. Kim, C. Kimball, E. J. King, P. J. King, M. Kinley-Hanlon, R. Kirchhoff, J. S. Kissel, L. Kleybolte, J. H. Klika, S. Klimenko, T. D. Knowles, P. Koch, S. M. Koehlenbeck, G. Koekoek, S. Koley, V. Kondrashov, A. Kontos, N. Koper, M. Korobko, W. Z. Korth, I. Kowalska, D. B. Kozak, V. Kringel, N. Krishnendu, A. Królak, G. Kuehn, A. Kumar, P. Kumar, R. Kumar, S. Kumar, L. Kuo, A. Kutynia, S. Kwang, B. D. Lackey, K. H. Lai, T. L. Lam, M. Landry, B. B. Lane, R. N. Lang, J. Lange, B. Lantz, R. K. Lanza, A. Lartaux-Vollard, P. D. Lasky, M. Laxen, A. Lazzarini, C. Lazzaro, P. Leaci, S. Leavey, Y. K. Lecoeuche, C. H. Lee, H. K. Lee, H. M. Lee, H. W. Lee, J. Lee, K. Lee, J. Lehmann, A. Lenon, N. Leroy, N. Letendre, Y. Levin, J. Li, K. J. L. Li, T. G. F. Li, X. Li, F. Lin, F. Linde, S. D. Linker, T. B. Littenberg, J. Liu, X. Liu, R. K. L. Lo, N. A. Lockerbie, L. T. London, A. Longo, M. Lorenzini, V. Loriette, M. Lormand, G. Losurdo, J. D. Lough, C. O. Lousto, G. Lovelace, M. E. Lower, H. Lück, D. Lumaca, A. P. Lundgren, R. Lynch, Y. Ma, R. Macas, S. Macfoy, M. MacInnis, D. M. Macleod, A. Macquet, F. Magaña-Sandoval, L. Magaña Zertuche, R. M. Magee, E. Majorana, I. Maksimovic, A. Malik, N. Man, V. Mandic, V. Mangano, G. L. Mansell, M. Manske, M. Mantovani, F. Marchesoni, F. Marion, S. Márka, Z. Márka, C. Markakis, A. S. Markosyan, A. Markowitz, E. Maros, A. Marquina, S. Marsat, F. Martelli, I. W. Martin, R. M. Martin, D. V. Martynov, K. Mason, E. Massera, A. Masserot, T. J. Massinger, M. Masso-Reid, S. Mastrogiovanni, A. Matas, F. Matichard, L. Matone, N. Mavalvala, N. Mazumder, J. J. McCann, R. McCarthy, D. E. McClelland, S. McCormick, L. McCuller, S. C. McGuire, J. McIver, D. J. McManus, T. McRae, S. T. McWilliams, D. Meacher, G. D. Meadors, M. Mehmet, A. K. Mehta, J. Meidam, A. Melatos, G. Mendell, R. A. Mercer, L. Mereni, E. L. Merilh, M. Merzougui, S. Meshkov, C. Messenger, C. Messick, R. Metzdorff, P. M. Meyers, H. Miao, C. Michel, H. Middleton, E. E. Mikhailov, L. Milano, A. L. Miller, A. Miller, M. Millhouse, J. C. Mills, M. C. Milovich-Goff, O. Minazzoli, Y. Minenkov, A. Mishkin, C. Mishra, T. Mistry, S. Mitra, V. P. Mitrofanov, G. Mitselmakher, R. Mittleman, G. Mo, D. Moffa, K. Mogushi, S. R. P. Mohapatra, M. Montani, C. J. Moore, D. Moraru, G. Moreno, S. Morisaki, B. Mours, C. M. Mow-Lowry, Arunava Mukherjee, D. Mukherjee, S. Mukherjee, N. Mukund, A. Mullavey, J. Munch, E. A. Muñiz, M. Muratore, P. G. Murray, A. Nagar, I. Nardecchia, L. Naticchioni, R. K. Nayak, J. Neilson, G. Nelemans, T. J. N. Nelson, M. Nery, A. Neunzert, K. Y. Ng, S. Ng, P. Nguyen, D. Nichols, A. B. Nielsen, S. Nissanke, A. Nitz, F. Nocera, C. North, L. K. Nuttall, M. Obergaulinger, J. Oberling, B. D. O’Brien, G. D. O’Dea, G. H. Ogin, J. J. Oh, S. H. Oh, F. Ohme, H. Ohta, M. A. Okada, M. Oliver, P. Oppermann, Richard J. Oram, B. O’Reilly, R. G. Ormiston, L. F. Ortega, R. O’Shaughnessy, S. Ossokine, D. J. Ottaway, H. Overmier, B. J. Owen, A. E. Pace, G. Pagano, M. A. Page, A. Pai, S. A. Pai, J. R. Palamos, O. Palashov, C. Palomba, A. Pal-Singh, Huang-Wei Pan, B. Pang, P. T. H. Pang, C. Pankow, F. Pannarale, B. C. Pant, F. Paoletti, A. Paoli, M. A. Papa, A. Parida, W. Parker, D. Pascucci, A. Pasqualetti, R. Passaquieti, D. Passuello, M. Patil, B. Patricelli, B. L. Pearlstone, C. Pedersen, M. Pedraza, R. Pedurand, A. Pele, S. Penn, A. Perego, C. J. Perez, A. Perreca, H. P. Pfeiffer, M. Phelps, K. S. Phukon, O. J. Piccinni, M. Pichot, F. Piergiovanni, G. Pillant, L. Pinard, M. Pirello, M. Pitkin, R. Poggiani, D. Y. T. Pong, S. Ponrathnam, P. Popolizio, E. K. Porter, J. Powell, A. K. Prajapati, J. Prasad, K. Prasai, R. Prasanna, G. Pratten, T. Prestegard, S. Privitera, G. A. Prodi, L. G. Prokhorov, O. Puncken, M. Punturo, P. Puppo, M. Pürrer, H. Qi, V. Quetschke, P. J. Quinonez, E. A. Quintero, R. Quitzow-James, F. J. Raab, H. Radkins, N. Radulescu, P. Raffai, S. Raja, C. Rajan, B. Rajbhandari, M. Rakhmanov, K. E. Ramirez, A. Ramos-Buades, Javed Rana, K. Rao, P. Rapagnani, V. Raymond, M. Razzano, J. Read, T. Regimbau, L. Rei, S. Reid, D. H. Reitze, W. Ren, F. Ricci, C. J. Richardson, J. W. Richardson, P. M. Ricker, G. M. Riemenschneider, K. Riles, M. Rizzo, N. A. Robertson, R. Robie, F. Robinet, A. Rocchi, L. Rolland, J. G. Rollins, V. J. Roma, M. Romanelli, R. Romano, C. L. Romel, J. H. Romie, K. Rose, D. Rosińska, S. G. Rosofsky, M. P. Ross, S. Rowan, A. Rüdiger, P. Ruggi, G. Rutins, K. Ryan, S. Sachdev, T. Sadecki, M. Sakellariadou, O. Salafia, L. Salconi, M. Saleem, F. Salemi, A. Samajdar, L. Sammut, E. J. Sanchez, L. E. Sanchez, N. Sanchis-Gual, V. Sandberg, J. R. Sanders, K. A. Santiago, N. Sarin, B. Sassolas, B. S. Sathyaprakash, P. R. Saulson, O. Sauter, R. L. Savage, P. Schale, M. Scheel, J. Scheuer, P. Schmidt, R. Schnabel, R. M. S. Schofield, A. Schönbeck, E. Schreiber, B. W. Schulte, B. F. Schutz, S. G. Schwalbe, J. Scott, S. M. Scott, E. Seidel, D. Sellers, A. S. Sengupta, N. Sennett, D. Sentenac, V. Sequino, A. Sergeev, Y. Setyawati, D. A. Shaddock, T. Shaffer, M. S. Shahriar, M. B. Shaner, L. Shao, P. Sharma, P. Shawhan, H. Shen, R. Shink, D. H. Shoemaker, D. M. Shoemaker, S. ShyamSundar, K. Siellez, M. Sieniawska, D. Sigg, A. D. Silva, L. P. Singer, N. Singh, A. Singhal, A. M. Sintes, S. Sitmukhambetov, V. Skliris, B. J. J. Slagmolen, T. J. Slaven-Blair, J. R. Smith, R. J. E. Smith, S. Somala, E. J. Son, B. Sorazu, F. Sorrentino, T. Souradeep, E. Sowell, A. P. Spencer, A. K. Srivastava, V. Srivastava, K. Staats, C. Stachie, M. Standke, D. A. Steer, M. Steinke, J. Steinlechner, S. Steinlechner, D. Steinmeyer, S. P. Stevenson, D. Stocks, R. Stone, D. J. Stops, K. A. Strain, G. Stratta, S. E. Strigin, A. Strunk, R. Sturani, A. L. Stuver, V. Sudhir, T. Z. Summerscales, L. Sun, S. Sunil, J. Suresh, P. J. Sutton, B. L. Swinkels, M. J. Szczepańczyk, M. Tacca, S. C. Tait, C. Talbot, D. Talukder, D. B. Tanner, M. Tápai, A. Taracchini, J. D. Tasson, R. Taylor, F. Thies, M. Thomas, P. Thomas, S. R. Thondapu, K. A. Thorne, E. Thrane, Shubhanshu Tiwari, Srishti Tiwari, V. Tiwari, K. Toland, M. Tonelli, Z. Tornasi, A. Torres-Forné, C. I. Torrie, D. Töyrä, F. Travasso, G. Traylor, M. C. Tringali, A. Trovato, L. Trozzo, R. Trudeau, K. W. Tsang, M. Tse, R. Tso, L. Tsukada, D. Tsuna, D. Tuyenbayev, K. Ueno, D. Ugolini, C. S. Unnikrishnan, A. L. Urban, S. A. Usman, H. Vahlbruch, G. Vajente, G. Valdes, N. van Bakel, M. van Beuzekom, J. F. J. van den Brand, C. Van Den Broeck, D. C. Vander-Hyde, J. V. van Heijningen, L. van der Schaaf, A. A. van Veggel, M. Vardaro, V. Varma, S. Vass, M. Vasúth, A. Vecchio, G. Vedovato, J. Veitch, P. J. Veitch, K. Venkateswara, G. Venugopalan, D. Verkindt, F. Vetrano, A. Viceré, A. D. Viets, D. J. Vine, J. Y. Vinet, S. Vitale, T. Vo, H. Vocca, C. Vorvick, S. P. Vyatchanin, A. R. Wade, L. E. Wade, M. Wade, R. Walet, M. Walker, L. Wallace, S. Walsh, G. Wang, H. Wang, J. Z. Wang, W. H. Wang, Y. F. Wang, R. L. Ward, Z. A. Warden, J. Warner, M. Was, J. Watchi, B. Weaver, L. W. Wei, M. Weinert, A. J. Weinstein, R. Weiss, F. Wellmann, L. Wen, E. K. Wessel, P. Weßels, J. W. Westhouse, K. Wette, J. T. Whelan, L. V. White, B. F. Whiting, C. Whittle, D. M. Wilken, D. Williams, A. R. Williamson, J. L. Willis, B. Willke, M. H. Wimmer, W. Winkler, C. C. Wipf, H. Wittel, G. Woan, J. Woehler, J. K. Wofford, J. Worden, J. L. Wright, D. S. Wu, D. M. Wysocki, L. Xiao, H. Yamamoto, C. C. Yancey, L. Yang, M. J. Yap, M. Yazback, D. W. Yeeles, Hang Yu, Haocun Yu, S. H. R. Yuen, M. Yvert, A. K. Zadrożny, M. Zanolin, F. Zappa, T. Zelenova, J. P. Zendri, M. Zevin, J. Zhang, L. Zhang, T. Zhang, C. Zhao, M. Zhou, Z. Zhou, X. J. Zhu, A. B. Zimmerman, Y. Zlochower, M. E. Zucker, and J. Zweizig. Gwtc-1: a gravitational-wave transient catalog of compact binary mergers observed by ligo and virgo during the first and second observing runs. Phys. Rev., X93:031040, 2019. arXiv:1811.12907, doi:10.1103/PhysRevX.9.031040. ↩↩↩

-

Timothy D. Gebhard, Niki Kilbertus, Ian Harry, and Bernhard Schölkopf. Convolutional neural networks: a magic bullet for gravitational-wave detection? arXiv, April 2019. arXiv:1904.08693v1. ↩↩↩↩

-

J. Slutsky and others. Methods for reducing false alarms in searches for compact binary coalescences in ligo data. Class. Quant. Grav., 27:165023, 2010. arXiv:1004.0998, doi:10.1088/0264-9381/27/16/165023. ↩

-

Alexander H. Nitz, Collin Capano, Alex B. Nielsen, Steven Reyes, Rebecca White, Duncan A. Brown, and Badri Krishnan. 1-ogc: the first open gravitational-wave catalog of binary mergers from analysis of public advanced ligo data. arXiv, November 2018. arXiv:1811.01921v3, doi:10.3847/1538-4357/ab0108. ↩↩↩

-

Alexander H. Nitz, Thomas Dent, Gareth S. Davies, Sumit Kumar, Collin D. Capano, Ian Harry, Simone Mazzon, Laura Nuttall, Andrew Lundgren, and Marton Tápai. 2-ogc: open gravitational-wave catalog of binary mergers from analysis of public advanced ligo and virgo data. arXiv, 2019. arXiv:1910.05331. ↩

-

Scott Coughlin. Updated gravity spy data set. 2018. doi:10.5281/ZENODO.1476551. ↩↩↩